La vida digital está aumentando las capacidades humanas y perturbando actividades humanas de hace siglos. Los sistemas impulsados por códigos se han extendido a más de la mitad de los habitantes del mundo en la información ambiental y la conectividad, ofreciendo oportunidades antes no imaginadas y amenazas sin precedentes. A medida que la inteligencia artificial (IA) emergente impulsada por algoritmos sigue extendiéndose, ¿estará la gente mejor que hoy?

Alrededor de 979 pioneros de la tecnología, innovadores, desarrolladores, líderes empresariales y políticos, investigadores y activistas respondieron a esta pregunta en un sondeo de expertos realizado en el verano de 2018.

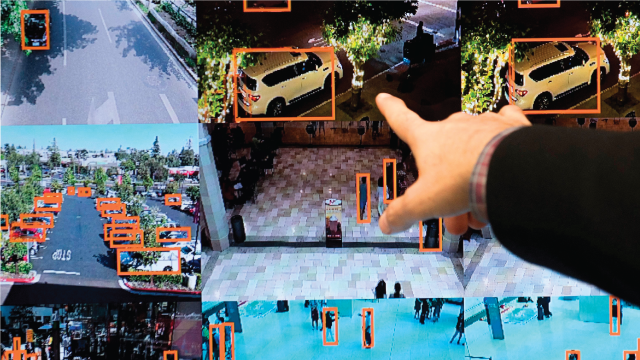

Los expertos predijeron que la inteligencia artificial en red amplificará la eficacia humana, pero también amenazará la autonomía, la agencia y las capacidades humanas. Hablaron de las amplias posibilidades; que los ordenadores podrían igualar o incluso superar la inteligencia y las capacidades humanas en tareas como la toma de decisiones complejas, el razonamiento y el aprendizaje, la analítica sofisticada y el reconocimiento de patrones, la agudeza visual, el reconocimiento del habla y la traducción de idiomas. Afirmaron que los sistemas «inteligentes» en las comunidades, en los vehículos, en los edificios y en los servicios públicos, en las granjas y en los procesos empresariales ahorrarán tiempo, dinero y vidas, y ofrecerán oportunidades para que las personas disfruten de un futuro más personalizado.

Muchos centraron sus comentarios optimistas en la atención sanitaria y en las numerosas aplicaciones posibles de la IA para diagnosticar y tratar a los pacientes o para ayudar a las personas mayores a llevar una vida más plena y saludable. También se mostraron entusiasmados con el papel de la IA a la hora de contribuir a los amplios programas de salud pública creados en torno a las enormes cantidades de datos que pueden obtenerse en los próximos años sobre todo tipo de cuestiones, desde el genoma personal hasta la nutrición. Además, varios de estos expertos predijeron que la IA propiciaría cambios largamente esperados en los sistemas educativos formales e informales.

Sin embargo, la mayoría de los expertos, independientemente de si son optimistas o no, expresaron su preocupación por el impacto a largo plazo de estas nuevas herramientas en los elementos esenciales del ser humano. A todos los encuestados en este sondeo no científico se les pidió que explicaran por qué creían que la IA dejaría a las personas en mejor situación o no. Muchos compartieron profundas preocupaciones, y muchos también sugirieron vías de solución. Los principales temas que mencionaron sobre las amenazas y los remedios se resumen en la tabla adjunta.

| Mayhem: Armas autónomas, ciberdelincuencia e información armada |

Algunos predicen una mayor erosión de las estructuras sociopolíticas tradicionales y la posibilidad de grandes pérdidas de vidas debido al crecimiento acelerado de las aplicaciones militares autónomas y el uso de información armada, mentiras y propaganda para desestabilizar peligrosamente a los grupos humanos. Algunos también temen el alcance de los ciberdelincuentes en los sistemas económicos. | |

CENTRO DE INVESTIGACIÓN PW Y CENTRO DE IMAGINACIÓN DE INTERNET DE LA UNIVERSIDAD DE ELON

Específicamente, se pidió a los participantes que consideraran lo siguiente:

«Por favor, piense en el año 2030. Los analistas prevén que las personas dependerán aún más de la inteligencia artificial (IA) en red en sistemas digitales complejos. Algunos dicen que continuaremos en el arco histórico de aumentar nuestras vidas con resultados mayormente positivos a medida que implementamos ampliamente estas herramientas en red. Otros afirman que nuestra creciente dependencia de esta IA y de los sistemas relacionados es probable que provoque dificultades generalizadas.

Nuestra pregunta: Para el año 2030, ¿cree que lo más probable es que el avance de la IA y los sistemas tecnológicos relacionados mejoren las capacidades humanas y las potencien? Es decir, la mayor parte del tiempo, ¿la mayoría de las personas estarán mejor que hoy? O bien, ¿es más probable que el avance de la IA y los sistemas tecnológicos relacionados disminuyan la autonomía y la agencia humanas hasta el punto de que la mayoría de las personas no estarán mejor que en la actualidad?»

En general, y a pesar de los inconvenientes que temen, el 63% de los encuestados en este sondeo dijo que tiene la esperanza de que la mayoría de las personas estarán mayormente mejor en 2030, y el 37% dijo que las personas no estarán mejor.

Algunos de los líderes de opinión que participaron en este sondeo afirmaron que la creciente dependencia de los seres humanos de los sistemas tecnológicos sólo irá bien si se presta mucha atención a cómo se diseñan, distribuyen y actualizan estas herramientas, plataformas y redes. Algunas de las respuestas más contundentes y generales fueron las de:

Sonia Katyal, codirectora del Centro de Derecho y Tecnología de Berkeley y miembro de la Junta de Asesores de la Economía Digital del Departamento de Comercio de EE.UU., predijo: «En 2030, el mayor conjunto de preguntas tendrá que ver con la forma en que las percepciones de la IA y su aplicación influirán en la trayectoria de los derechos civiles en el futuro. Las cuestiones sobre la privacidad, la expresión, el derecho de reunión y la construcción tecnológica de la personalidad volverán a surgir en este nuevo contexto de la IA, poniendo en duda nuestras creencias más arraigadas sobre la igualdad y las oportunidades para todos. Quién se beneficiará y quién se verá perjudicado en este nuevo mundo depende de la amplitud con la que analicemos estas cuestiones hoy, para el futuro».

Tenemos que trabajar con ahínco para asegurarnos de que la tecnología se ajusta a nuestros valores.Erik Brynjolfsson

Erik Brynjolfsson, director de la Iniciativa del MIT sobre la Economía Digital y autor de «Machine, Platform, Crowd: Harnessing Our Digital Future», dijo: «La IA y las tecnologías relacionadas ya han alcanzado un rendimiento sobrehumano en muchas áreas, y hay pocas dudas de que sus capacidades mejorarán, probablemente de forma muy significativa, para 2030. … Creo que es más probable que utilicemos este poder para hacer del mundo un lugar mejor. Por ejemplo, podemos eliminar prácticamente la pobreza global, reducir masivamente las enfermedades y proporcionar una mejor educación a casi todos los habitantes del planeta. Dicho esto, la IA y el ML también pueden utilizarse para concentrar cada vez más la riqueza y el poder, dejando atrás a muchas personas, y para crear armas aún más horribles. Ninguno de los dos resultados es inevitable, por lo que la pregunta correcta no es «¿Qué pasará?», sino «¿Qué elegiremos hacer?». Tenemos que trabajar enérgicamente para que la tecnología se ajuste a nuestros valores. Esto puede y debe hacerse a todos los niveles, desde el gobierno hasta las empresas, el mundo académico y las decisiones individuales».

Bryan Johnson, fundador y director general de Kernel, una empresa líder en el desarrollo de interfaces neuronales avanzadas, y de OS Fund, una empresa de capital riesgo, dijo: «Creo firmemente que la respuesta depende de si podemos cambiar nuestros sistemas económicos para dar prioridad a la mejora humana radical y frenar la tendencia a la irrelevancia humana frente a la IA. No me refiero sólo a los puestos de trabajo; me refiero a la irrelevancia real y existencial, que es el resultado final de no priorizar el bienestar y la cognición humanos».

Marina Gorbis, directora ejecutiva del Institute for the Future, dijo: «Si no se producen cambios significativos en nuestra economía política y en los regímenes de gobernanza de datos es probable que se produzcan mayores desigualdades económicas, más vigilancia y más interacciones programadas y no centradas en el ser humano. Cada vez que programamos nuestros entornos, acabamos programándonos a nosotros mismos y a nuestras interacciones. Los humanos tienen que estandarizarse más, eliminando la serendipia y la ambigüedad de nuestras interacciones. Y esta ambigüedad y complejidad son la esencia del ser humano».

Judith Donath, autora de «The Social Machine, Designs for Living Online» y miembro de la facultad del Berkman Klein Center for Internet & Society de la Universidad de Harvard, comentó: «En 2030, la mayoría de las situaciones sociales serán facilitadas por bots -programas de apariencia inteligente que interactúan con nosotros de forma similar a los humanos. En casa, los padres contratarán a bots expertos para que ayuden a los niños con los deberes y catalicen las conversaciones de la cena. En el trabajo, los bots dirigirán las reuniones. Un bot confidente se considerará esencial para el bienestar psicológico, y cada vez recurriremos más a estos compañeros para que nos aconsejen desde qué ropa llevar hasta con quién casarnos. A los humanos nos importa mucho cómo nos ven los demás, y los demás cuya aprobación buscamos serán cada vez más artificiales. Para entonces, la diferencia entre humanos y bots se habrá difuminado considerablemente. A través de la pantalla y la proyección, la voz, la apariencia y los comportamientos de los bots serán indistinguibles de los de los humanos, e incluso los robots físicos, aunque obviamente no sean humanos, serán tan convincentemente sinceros que nuestra impresión de que son seres pensantes y con sentimientos, a la par o superiores a nosotros, será inamovible. Además de la ambigüedad, nuestra propia comunicación se verá fuertemente aumentada: Los programas compondrán muchos de nuestros mensajes y nuestra apariencia en línea/AR será elaborada computacionalmente. (El habla y el comportamiento humano en bruto y sin ayuda parecerán vergonzosamente toscos, lentos y poco sofisticados). Con la ayuda de su acceso a grandes cantidades de datos sobre cada uno de nosotros, los bots superarán con creces a los humanos en su capacidad de atraer y persuadir. Capaces de imitar las emociones de forma experta, nunca se dejarán vencer por los sentimientos: Si sueltan algo con rabia, será porque ese comportamiento estaba calculado para ser la forma más eficaz de avanzar hacia los objetivos que tenían «en mente». Pero, ¿cuáles son esos objetivos? Los compañeros artificialmente inteligentes cultivarán la impresión de que les motivan objetivos sociales similares a los nuestros: ser bien considerados, ya sea como un amigo querido, un jefe admirado, etc. Pero su verdadera colaboración será con los humanos y las instituciones que los controlan. Al igual que sus antepasados de hoy, estos serán vendedores de bienes que los emplean para estimular el consumo y políticos que los encargan para influir en las opiniones».

Andrew McLaughlin, director ejecutivo del Centro de Pensamiento Innovador de la Universidad de Yale, anteriormente subdirector de tecnología de Estados Unidos para el presidente Barack Obama y jefe de política pública global de Google, escribió: «2030 no está lejos en el futuro. Tengo la sensación de que innovaciones como Internet y la inteligencia artificial en red tienen enormes beneficios a corto plazo, junto con efectos negativos a largo plazo que pueden tardar décadas en ser reconocibles. La IA impulsará una amplia gama de optimizaciones de la eficiencia, pero también permitirá la discriminación oculta y la penalización arbitraria de las personas en ámbitos como los seguros, la búsqueda de empleo y la evaluación del rendimiento».

Michael M. Roberts, primer presidente y director general de la Corporación para la Asignación de Nombres y Números en Internet (ICANN) y miembro del Salón de la Fama de Internet, escribió: «El abanico de oportunidades para que los agentes inteligentes aumenten la inteligencia humana sigue siendo prácticamente ilimitado. El principal problema es que cuanto más conveniente es un agente, más necesita saber sobre usted -preferencias, horarios, capacidades, etc. – lo que crea una disyuntiva de que más ayuda requiere más intrusión. No se trata de una cuestión en blanco y negro: los matices de gris y los remedios asociados se discutirán sin cesar. Hasta la fecha, se ha demostrado que la comodidad supera a la privacidad. Sospecho que seguirá siendo así».

Danah Boyd, investigadora principal de Microsoft y fundadora y presidenta del Instituto de Investigación de la Sociedad de Datos&, dijo: «La IA es una herramienta que será utilizada por los humanos para todo tipo de fines, incluida la búsqueda de poder. Habrá abusos de poder que impliquen a la IA, al igual que habrá avances en la ciencia y los esfuerzos humanitarios que también impliquen a la IA». Desgraciadamente, hay ciertas líneas de tendencia que pueden crear una inestabilidad masiva. Por ejemplo, el cambio climático y la migración climática. Esto desestabilizará aún más a Europa y Estados Unidos, y espero que, con el pánico, veamos cómo se utiliza la IA de forma perjudicial a la luz de otras crisis geopolíticas».

Amy Webb, fundadora del Future Today Institute y profesora de previsión estratégica en la Universidad de Nueva York, comentó: «Las estructuras de la red de seguridad social que existen actualmente en Estados Unidos y en muchos otros países del mundo no fueron diseñadas para nuestra transición a la IA. La transición a la IA durará los próximos 50 años o más. A medida que nos adentremos en esta tercera era de la computación, y que cada industria se afiance más con los sistemas de IA, necesitaremos nuevos trabajadores del conocimiento con habilidades híbridas que puedan operar en trabajos que nunca han necesitado existir antes. Necesitaremos agricultores que sepan trabajar con grandes conjuntos de datos. Oncólogos formados como robóticos. Biólogos formados como ingenieros eléctricos. No necesitaremos preparar nuestra mano de obra una sola vez, con unos pocos cambios en el plan de estudios. A medida que la IA madure, necesitaremos una mano de obra receptiva, capaz de adaptarse a nuevos procesos, sistemas y herramientas cada pocos años. La necesidad de estos campos surgirá más rápido de lo que nuestros departamentos de trabajo, escuelas y universidades están reconociendo. Es fácil mirar la historia a través de la lente del presente y pasar por alto el malestar social causado por el desempleo tecnológico generalizado. Tenemos que abordar una verdad difícil que pocos están dispuestos a pronunciar en voz alta: La IA acabará provocando el desempleo permanente de un gran número de personas. Al igual que las generaciones anteriores fueron testigos de cambios radicales durante y después de la Revolución Industrial, el rápido ritmo de la tecnología probablemente significará que los Baby Boomers y los miembros más antiguos de la Generación X -especialmente aquellos cuyos trabajos pueden ser replicados por los robots- no podrán reciclarse para otro tipo de trabajo sin una inversión significativa de tiempo y esfuerzo.»

Barry Chudakov, fundador y director de Sertain Research, comentó: «En 2030, la colaboración hombre-máquina/AI será una herramienta necesaria para gestionar y contrarrestar los efectos de múltiples aceleraciones simultáneas: el amplio avance tecnológico, la globalización, el cambio climático y las consiguientes migraciones globales. En el pasado, las sociedades humanas gestionaban el cambio mediante el instinto y la intuición, pero como ha dicho Eric Teller, director general de Google X, «nuestras estructuras sociales no consiguen seguir el ritmo del cambio». Para seguir el ritmo de ese cambio y gestionar una lista cada vez mayor de «problemas perversos» de aquí a 2030, la IA -o, utilizando la expresión de Joi Ito, la inteligencia extendida- valorará y revalorizará prácticamente todos los ámbitos del comportamiento y la interacción humanos. La IA y las tecnologías avanzadas cambiarán nuestro marco de respuesta y nuestros plazos (lo que, a su vez, cambia nuestro sentido del tiempo). Donde antes la interacción social ocurría en lugares -trabajo, escuela, iglesia, entornos familiares-, las interacciones sociales ocurrirán cada vez más en tiempo continuo y simultáneo. Si tenemos suerte, seguiremos los 23 principios de la IA de Asilomar esbozados por el Instituto del Futuro de la Vida y trabajaremos hacia una «inteligencia no indirecta, sino beneficiosa». Al igual que la disuasión nuclear derivada de la destrucción mutua asegurada, la IA y los sistemas tecnológicos relacionados constituyen una fuerza para el renacimiento moral. Debemos abrazar ese renacimiento moral, o nos enfrentaremos a enigmas morales que podrían provocar la desaparición de la humanidad. … Mi mayor esperanza para la colaboración hombre-máquina/AI constituye un renacimiento moral y ético: adoptamos una mentalidad de «moonshot» y nos armamos para prepararnos para las aceleraciones que vienen hacia nosotros. Mi mayor temor es que adoptemos la lógica de nuestras tecnologías emergentes -respuesta instantánea, aislamiento tras las pantallas, comparación interminable de la autoestima, falsa autopresentación- sin pensar ni responder de forma inteligente»

John C. Havens, director ejecutivo de la Iniciativa Global del IEEE sobre Ética de los Sistemas Autónomos e Inteligentes y del Consejo de Inteligencia Extendida, escribió: «Ahora, en 2018, la mayoría de las personas de todo el mundo no pueden acceder a sus datos, por lo que cualquier debate sobre el «aumento de la IA humana» ignora el contexto crítico de quién controla realmente la información y la identidad de las personas. Pronto será extremadamente difícil identificar cualquier sistema autónomo o inteligente cuyos algoritmos no interactúen con datos humanos de una u otra forma»

Lo que está en juego es nada menos que el tipo de sociedad en la que queremos vivir y cómo experimentamos nuestra humanidad.Batya Friedman

Batya Friedman, profesora de interacción persona-ordenador en la Escuela de Información de la Universidad de Washington, escribió: «Nuestras capacidades científicas y tecnológicas han superado y seguirán superando con creces nuestras capacidades morales, es decir, nuestra capacidad para utilizar con sabiduría y humanidad los conocimientos y herramientas que desarrollamos. … La guerra automatizada -cuando las armas autónomas matan a seres humanos sin participación humana- puede llevar a una falta de responsabilidad por haber quitado la vida al enemigo o incluso a saber que se ha quitado la vida a un enemigo. Lo que está en juego es nada menos que el tipo de sociedad en la que queremos vivir y cómo experimentamos nuestra humanidad».

Greg Shannon, científico jefe de la División CERT de la Universidad Carnegie Mellon, dijo: «Mejor/peor aparecerá en una proporción de 4:1 y a largo plazo será de 2:1. La IA irá bien para trabajos repetitivos en los que «casi» será suficiente y a los humanos les disgusta el trabajo. … La vida será definitivamente mejor a medida que la IA alargue el tiempo de vida, desde las aplicaciones de salud que nos «empujen» inteligentemente a la salud, hasta las advertencias sobre eventos inminentes de corazón/apoplejía, pasando por la atención sanitaria automatizada para los desatendidos (a distancia) y los que necesitan cuidados prolongados (cuidado de ancianos). En cuanto a la libertad, existen claros riesgos. La IA afecta a la agencia al crear entidades con capacidades intelectuales significativas para supervisar, hacer cumplir e incluso castigar a los individuos. Los que sepan utilizarla tendrán un inmenso poder potencial sobre los que no sepan o no puedan. La felicidad futura no está muy clara. Algunos cederán su agencia a la IA en los juegos, el trabajo y la comunidad, al igual que la crisis de los opioides roba la agencia hoy en día. Por otro lado, muchos se verán liberados de tareas/trabajos mundanos y poco atractivos. Si los elementos de felicidad de la comunidad forman parte de las funciones objetivo de la IA, ésta podría catalizar una explosión de felicidad».

Kostas Alexandridis, autor de «Exploring Complex Dynamics in Multi-agent-based Intelligent Systems», predijo: «Muchas de nuestras decisiones cotidianas se automatizarán con una intervención mínima del usuario final. La autonomía y/o la independencia se sacrificarán y serán sustituidas por la comodidad. Las nuevas generaciones de ciudadanos dependerán cada vez más de las estructuras y procesos de la IA en red. Hay desafíos que deben ser abordados en términos de pensamiento crítico y heterogeneidad. La interdependencia en red aumentará, con toda probabilidad, nuestra vulnerabilidad a los ciberataques. También hay una probabilidad real de que existan divisiones más agudas entre los «ricos» y los «pobres» digitales, así como entre las infraestructuras digitales tecnológicamente dependientes. Por último, está la cuestión de las nuevas «alturas de mando» de la propiedad y el control de la infraestructura de la red digital».

Oscar Gandy, profesor emérito de comunicación de la Universidad de Pensilvania, respondió: «Ya nos enfrentamos a una suposición no concedida cuando se nos pide que imaginemos la «colaboración» hombre-máquina. La interacción es un poco diferente, pero sigue estando contaminada por la concesión de una forma de identidad -quizá incluso de persona- a las máquinas que utilizaremos para abrirnos paso en todo tipo de oportunidades y desafíos. Los problemas a los que nos enfrentaremos en el futuro son bastante similares a los que tenemos en la actualidad cuando dependemos de «otros» (incluidos los sistemas, dispositivos y redes tecnológicas) para adquirir cosas que valoramos y evitar esas otras cosas (de las que podríamos ser conscientes o no)»

James Scofield O’Rourke, profesor de gestión de la Universidad de Notre Dame, dijo: «La tecnología ha sido, a lo largo de la historia registrada, un concepto en gran medida neutral. La cuestión de su valor siempre ha dependido de su aplicación. ¿Para qué se utilizarán la IA y otros avances tecnológicos? Todo, desde la pólvora hasta los motores de combustión interna y la fisión nuclear, se ha aplicado de forma útil y destructiva. Suponiendo que podamos contener o controlar la IA (y no al revés), la respuesta a si estaremos mejor depende enteramente de nosotros (o de nuestra progenie). La culpa, querido Bruto, no está en nuestras estrellas, sino en nosotros mismos, que somos subalternos».

Simon Biggs, profesor de artes interdisciplinarias en la Universidad de Edimburgo, dijo: «La IA funcionará para aumentar las capacidades humanas. El problema no es con la IA, sino con los humanos. Como especie, somos agresivos, competitivos y perezosos. Pero también somos empáticos, comunitarios y (a veces) abnegados. Tenemos muchos otros atributos. Todos ellos se verán amplificados. Teniendo en cuenta los precedentes históricos, habría que suponer que serán nuestras peores cualidades las que se vean aumentadas. Mi expectativa es que en 2030 la IA se utilizará de forma rutinaria para luchar en guerras y matar a la gente, de forma mucho más eficaz de lo que podemos matar actualmente. Como sociedades, esto nos afectará menos que en la actualidad, ya que no lucharemos ni mataremos nosotros mismos. Nuestra capacidad de modificar nuestro comportamiento, sujeta a la empatía y a un marco ético asociado, se verá reducida por la disociación entre nuestra agencia y el acto de matar. No podemos esperar que nuestros sistemas de IA sean éticos en nuestro nombre: no lo serán, ya que estarán diseñados para matar de forma eficiente, no reflexiva. Mi otra preocupación principal tiene que ver con la vigilancia y el control. El advenimiento del Sistema de Crédito Social (SCS) de China es un indicador de lo que probablemente vendrá. Existiremos dentro de un SCS como instancias híbridas construidas por la IA que pueden o no parecerse a quienes somos. Pero nuestros derechos y asequibilidades como individuos estarán determinados por el SCS. Esta es la pesadilla orwelliana hecha realidad».

Mark Surman, director ejecutivo de la Fundación Mozilla, respondió: «La IA seguirá concentrando el poder y la riqueza en manos de unos pocos grandes monopolios con sede en Estados Unidos y China. La mayoría de las personas -y partes del mundo- estarán peor».

William Uricchio, estudioso de los medios de comunicación y profesor de estudios comparativos de medios en el MIT, comentó: «La IA y sus aplicaciones relacionadas se enfrentan a tres problemas: el desarrollo a la velocidad de la Ley de Moore, el desarrollo en manos de una élite tecnológica y económica, y el desarrollo sin el beneficio de un público informado o comprometido. El público se reduce a un colectivo de consumidores a la espera de la próxima tecnología. ¿Qué concepto de «progreso» prevalecerá? Tenemos muchas pruebas de que la IA se utiliza para obtener beneficios, sin tener en cuenta las implicaciones para los valores que se han mantenido durante mucho tiempo; para mejorar el control gubernamental e incluso para obtener el «crédito social» de los ciudadanos sin que éstos participen. Al igual que las tecnologías anteriores, la IA es agnóstica. Su despliegue está en manos de la sociedad. Sin embargo, a falta de un público con conocimientos de IA, la decisión sobre la mejor manera de desplegarla recaerá en los intereses particulares. ¿Significará esto un despliegue equitativo, la mejora de la injusticia social y la IA en el servicio público? Como la respuesta a esta pregunta es más social que tecnológica, soy pesimista. ¿La solución? Tenemos que desarrollar un público con conocimientos de IA, lo que implica una atención especial en el sector educativo y en los medios de comunicación de cara al público. Tenemos que garantizar la diversidad en el desarrollo de las tecnologías de IA. Y hasta que el público, sus representantes electos y sus regímenes legales y reguladores puedan ponerse al día con estos rápidos desarrollos, debemos ser cautos y supervisar el desarrollo de la IA».

El resto de este informe se divide en tres secciones que se basan en las esperanzadoras y críticas observaciones de cientos de encuestados adicionales: 1) las preocupaciones sobre la evolución de la IA humana, 2) las soluciones sugeridas para abordar el impacto de la IA, y 3) las expectativas de cómo será la vida en 2030, incluyendo las perspectivas positivas de los encuestados sobre la calidad de vida y el futuro del trabajo, la atención sanitaria y la educación. Algunas respuestas están ligeramente editadas por razones de estilo.