La vie numérique augmente les capacités humaines et perturbe les activités humaines séculaires. Les systèmes pilotés par des codes se sont propagés à plus de la moitié des habitants de la planète dans l’information et la connectivité ambiantes, offrant des opportunités jusqu’alors inimaginables et des menaces sans précédent. Alors que l’intelligence artificielle (IA) émergente pilotée par des algorithmes continue de se répandre, les gens seront-ils mieux lotis qu’aujourd’hui ?

Quelque 979 pionniers de la technologie, innovateurs, développeurs, chefs d’entreprise et responsables politiques, chercheurs et activistes ont répondu à cette question dans le cadre d’un démarchage d’experts mené au cours de l’été 2018.

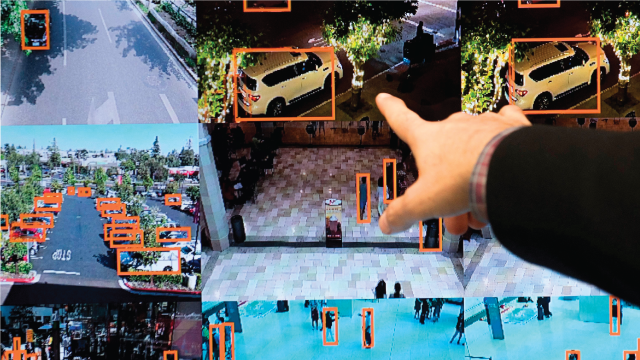

Les experts ont prédit que l’intelligence artificielle en réseau amplifiera l’efficacité humaine, mais menacera également l’autonomie, l’agence et les capacités humaines. Ils ont parlé des possibilités étendues ; que les ordinateurs pourraient égaler ou même dépasser l’intelligence et les capacités humaines sur des tâches telles que la prise de décision complexe, le raisonnement et l’apprentissage, l’analyse sophistiquée et la reconnaissance des formes, l’acuité visuelle, la reconnaissance vocale et la traduction des langues. Ils ont déclaré que les systèmes « intelligents » dans les communautés, dans les véhicules, dans les bâtiments et les services publics, dans les exploitations agricoles et dans les processus commerciaux permettront de gagner du temps, de l’argent et des vies et offriront aux individus la possibilité de profiter d’un avenir plus personnalisé.

Beaucoup ont axé leurs remarques optimistes sur les soins de santé et les nombreuses applications possibles de l’IA pour diagnostiquer et traiter les patients ou aider les personnes âgées à vivre plus pleinement et en meilleure santé. Ils étaient également enthousiastes quant au rôle de l’IA dans la contribution à de vastes programmes de santé publique construits autour de quantités massives de données qui pourraient être capturées dans les années à venir sur tout, du génome personnel à la nutrition. En outre, un certain nombre de ces experts ont prédit que l’IA favoriserait les changements attendus depuis longtemps dans les systèmes d’éducation formels et informels.

Pour autant, la plupart des experts, qu’ils soient optimistes ou non, ont exprimé des inquiétudes quant à l’impact à long terme de ces nouveaux outils sur les éléments essentiels de l’être humain. Toutes les personnes interrogées dans le cadre de ce démarchage non scientifique ont été invitées à préciser pourquoi elles pensaient que l’IA laisserait les gens en meilleure posture ou non. Beaucoup ont fait part de leurs profondes inquiétudes, et beaucoup ont également suggéré des pistes de solutions. Les principaux thèmes qu’ils ont sondés sur les menaces et les remèdes sont présentés dans le tableau ci-joint.

L’IA et l’avenir des humains : Les experts expriment leurs inquiétudes et proposent des solutions

| Mayhem: Armes autonomes, cybercriminalité et information militarisée |

Certains prédisent une nouvelle érosion des structures sociopolitiques traditionnelles et la possibilité de grandes pertes de vies en raison de la croissance accélérée des applications militaires autonomes et de l’utilisation d’informations militarisées, de mensonges et de propagande pour déstabiliser dangereusement les groupes humains. Certains craignent également l’emprise des cybercriminels sur les systèmes économiques. | |

PEW RESEARCH CENTER AND ELON UNIVERSITY’S IMAGINING THE INTERNET CENTER

Spécifiquement, les participants ont été invités à considérer ce qui suit :

« Veuillez penser à l’année 2030. Les analystes s’attendent à ce que les gens deviennent encore plus dépendants de l’intelligence artificielle (IA) en réseau dans des systèmes numériques complexes. Certains disent que nous continuerons sur l’arc historique de l’augmentation de nos vies avec des résultats généralement positifs alors que nous mettons largement en œuvre ces outils en réseau. Certains disent que notre dépendance croissante à l’égard de ces IA et des systèmes connexes est susceptible de conduire à des difficultés généralisées.

Notre question : D’ici 2030, pensez-vous qu’il est le plus probable que les progrès de l’IA et des systèmes technologiques connexes améliorent les capacités humaines et les rendent autonomes ? C’est-à-dire que, la plupart du temps, la plupart des gens seront mieux lotis qu’ils ne le sont aujourd’hui ? Ou est-il plus probable que l’avancement de l’IA et des systèmes technologiques connexes diminuera l’autonomie et l’agence humaines à tel point que la plupart des gens ne seront pas mieux lotis que la façon dont les choses sont aujourd’hui ? »

Dans l’ensemble, et malgré les inconvénients qu’ils redoutent, 63% des personnes interrogées dans le cadre de ce démarchage ont dit avoir l’espoir que la plupart des individus seront pour la plupart mieux lotis en 2030, et 37% ont dit que les gens ne seront pas mieux lotis.

Un certain nombre de leaders d’opinion qui ont participé à cette prospection ont déclaré que la dépendance croissante des humains à l’égard des systèmes technologiques ne se passera bien que si une attention particulière est accordée à la façon dont ces outils, plateformes et réseaux sont conçus, distribués et mis à jour. Parmi les réponses puissantes et globales, citons celles de :

Sonia Katyal, codirectrice du Berkeley Center for Law and Technology et membre du premier Digital Economy Board of Advisors du ministère américain du Commerce, a prédit : « En 2030, le plus grand ensemble de questions concernera la façon dont les perceptions de l’IA et leur application influenceront la trajectoire des droits civils à l’avenir. Les questions relatives au respect de la vie privée, à la liberté d’expression, au droit de réunion et à la construction technologique de la personnalité réapparaîtront toutes dans ce nouveau contexte d’IA, remettant en question nos croyances les plus profondes en matière d’égalité et d’opportunités pour tous. Qui bénéficiera et qui sera désavantagé dans ce nouveau monde dépend de la façon dont nous analysons ces questions aujourd’hui, pour l’avenir. »

Nous devons travailler agressivement pour nous assurer que la technologie correspond à nos valeurs.Erik Brynjolfsson

Erik Brynjolfsson, directeur de l’initiative du MIT sur l’économie numérique et auteur de « Machine, Platform, Crowd : Harnessing Our Digital Future », a déclaré : « L’IA et les technologies connexes ont déjà atteint des performances surhumaines dans de nombreux domaines, et il ne fait guère de doute que leurs capacités vont s’améliorer, probablement de manière très significative, d’ici 2030. … Je pense qu’il est plus que probable que nous utiliserons cette puissance pour rendre le monde meilleur. Par exemple, nous pouvons pratiquement éliminer la pauvreté mondiale, réduire massivement les maladies et offrir une meilleure éducation à presque tous les habitants de la planète. Cela dit, l’IA et le ML peuvent également être utilisés pour concentrer de plus en plus la richesse et le pouvoir, laissant de nombreuses personnes derrière, et pour créer des armes encore plus horribles. Aucune des deux issues n’étant inévitable, la bonne question n’est pas « Que va-t-il se passer ? » mais « Que choisirons-nous de faire ? ». Nous devons travailler énergiquement pour nous assurer que la technologie correspond à nos valeurs. Cela peut et doit être fait à tous les niveaux, du gouvernement, aux entreprises, aux universités et aux choix individuels. »

Bryan Johnson, fondateur et PDG de Kernel, un développeur de pointe d’interfaces neurales avancées, et d’OS Fund, une société de capital-risque, a déclaré : « Je crois fermement que la réponse dépend de notre capacité à faire évoluer nos systèmes économiques pour donner la priorité à l’amélioration radicale de l’homme et endiguer la tendance à la non-pertinence de l’homme face à l’IA. Je ne parle pas seulement d’emplois ; je parle d’une véritable insignifiance existentielle, qui est le résultat final de ne pas donner la priorité au bien-être et à la cognition de l’homme. »

Marina Gorbis, directrice exécutive de l’Institute for the Future, a déclaré : « Sans changements significatifs dans notre économie politique et nos régimes de gouvernance des données est susceptible de créer de plus grandes inégalités économiques, plus de surveillance et plus d’interactions programmées et non centrées sur l’homme. Chaque fois que nous programmons nos environnements, nous finissons par nous programmer nous-mêmes et nos interactions. Les humains doivent devenir plus standardisés, éliminant la sérendipité et l’ambiguïté de nos interactions. Or, cette ambiguïté et cette complexité sont l’essence même de l’être humain. »

Judith Donath, auteur de « The Social Machine, Designs for Living Online » et membre de la faculté du Berkman Klein Center for Internet & Society de l’Université de Harvard, a commenté : « D’ici 2030, la plupart des situations sociales seront facilitées par des bots – des programmes à l’apparence intelligente qui interagissent avec nous de manière semblable à celle des humains. À la maison, les parents engageront des bots qualifiés pour aider les enfants à faire leurs devoirs et catalyser les conversations du dîner. Au travail, les bots dirigeront les réunions. Un confident virtuel sera considéré comme essentiel au bien-être psychologique, et nous nous tournerons de plus en plus vers ces compagnons pour obtenir des conseils allant de la manière de s’habiller à la personne à épouser. Nous, les humains, sommes profondément attachés à la façon dont les autres nous perçoivent – et les autres dont nous recherchons l’approbation seront de plus en plus artificiels. D’ici là, la différence entre les humains et les robots se sera considérablement estompée. Grâce aux écrans et aux projections, il sera impossible de distinguer la voix, l’apparence et le comportement des robots de ceux des humains, et même les robots physiques, bien que manifestement non humains, seront d’une sincérité si convaincante que notre impression qu’ils sont des êtres pensants et sensibles, égaux ou supérieurs à nous-mêmes, sera inébranlable. Pour ajouter à l’ambiguïté, notre propre communication sera fortement augmentée : Des programmes composeront un grand nombre de nos messages et notre apparence en ligne/AR sera élaborée par ordinateur. (La parole et le comportement humains bruts, sans aide, sembleront embarrassants, lents et peu sophistiqués). Grâce à leur accès à de vastes quantités de données sur chacun d’entre nous, les robots dépasseront de loin les humains dans leur capacité à nous attirer et à nous persuader. Capables d’imiter les émotions de manière experte, ils ne seront jamais dépassés par les sentiments : S’ils laissent échapper quelque chose sous le coup de la colère, ce sera parce que ce comportement a été calculé pour être le moyen le plus efficace d’atteindre les objectifs qu’ils avaient « en tête ». Mais quels sont ces objectifs ? Les compagnons artificiellement intelligents cultiveront l’impression que des objectifs sociaux similaires aux nôtres les motivent – être tenu en bonne estime, qu’il s’agisse d’un ami bien-aimé, d’un patron admiré, etc. Mais leur véritable collaboration se fera avec les humains et les institutions qui les contrôlent. Comme leurs ancêtres d’aujourd’hui, il s’agira de vendeurs de biens qui les emploient pour stimuler la consommation et de politiciens qui les mandatent pour influencer les opinions. »

Andrew McLaughlin, directeur exécutif du Center for Innovative Thinking de l’université de Yale, précédemment directeur adjoint de la technologie des États-Unis pour le président Barack Obama et responsable de la politique publique mondiale pour Google, écrit : « 2030 n’est pas loin dans le futur. J’ai le sentiment que des innovations telles que l’internet et l’IA en réseau présentent des avantages massifs à court terme, ainsi que des inconvénients à long terme qui peuvent mettre des décennies à se manifester. L’IA sera à l’origine d’une vaste gamme d’optimisations de l’efficacité, mais permettra également une discrimination cachée et une pénalisation arbitraire des individus dans des domaines tels que l’assurance, la recherche d’emploi et l’évaluation des performances. »

Michael M. Roberts, premier président et directeur général de l’Internet Corporation for Assigned Names and Numbers (ICANN) et membre de l’Internet Hall of Fame, a écrit : « L’éventail des possibilités pour les agents intelligents d’augmenter l’intelligence humaine est encore pratiquement illimité. Le principal problème est que plus un agent est pratique, plus il doit en savoir sur vous – préférences, calendrier, capacités, etc. – ce qui crée un compromis entre une aide accrue et une intrusion plus importante. Il ne s’agit pas d’un problème noir et blanc – les nuances de gris et les remèdes associés seront discutés sans fin. Le bilan à ce jour est que la commodité l’emporte sur la vie privée. Je soupçonne que cela va continuer. »

danah boyd, chercheur principal chez Microsoft et fondateur et président du Data & Society Research Institute, a déclaré : « L’IA est un outil qui sera utilisé par les humains à toutes sortes de fins, y compris dans la poursuite du pouvoir. Il y aura des abus de pouvoir qui impliqueront l’IA, tout comme il y aura des avancées dans la science et des efforts humanitaires qui impliqueront également l’IA ». Malheureusement, certaines lignes de tendance sont susceptibles de créer une instabilité massive. Prenez, par exemple, le changement climatique et la migration climatique. Cela déstabilisera encore plus l’Europe et les États-Unis, et je m’attends à ce que, dans la panique, nous voyions l’IA être utilisée de manière néfaste à la lumière d’autres crises géopolitiques. »

Amy Webb, fondatrice de l’Institut Future Today et professeur de prospective stratégique à l’Université de New York, a commenté : « Les structures de filet de sécurité sociale actuellement en place aux États-Unis et dans de nombreux autres pays du monde n’ont pas été conçues pour notre transition vers l’IA. La transition vers l’IA durera les 50 prochaines années, voire plus. À mesure que nous avançons dans cette troisième ère de l’informatique et que chaque industrie s’enracine plus profondément dans les systèmes d’IA, nous aurons besoin de nouveaux travailleurs du savoir aux compétences hybrides, capables d’occuper des emplois qui n’ont jamais eu besoin d’exister auparavant. Nous aurons besoin d’agriculteurs qui sauront travailler avec de grands ensembles de données. D’oncologues formés comme des roboticiens. De biologistes formés comme des ingénieurs électriciens. Nous n’aurons pas besoin de préparer notre main-d’œuvre une seule fois, avec quelques changements dans le programme d’études. À mesure que l’IA gagnera en maturité, nous aurons besoin d’une main-d’œuvre réactive, capable de s’adapter à de nouveaux processus, systèmes et outils tous les deux ans. Les besoins dans ces domaines apparaîtront plus rapidement que ne le reconnaissent nos ministères du travail, nos écoles et nos universités. Il est facile de regarder l’histoire à travers le prisme du présent – et de négliger les troubles sociaux causés par un chômage technologique généralisé. Nous devons nous attaquer à une vérité difficile que peu de gens sont prêts à énoncer à voix haute : L’IA finira par priver un grand nombre de personnes de travail de façon permanente. Tout comme les générations précédentes ont été témoins de changements radicaux pendant et après la révolution industrielle, le rythme rapide de la technologie signifiera probablement que les baby-boomers et les membres les plus âgés de la génération X – en particulier ceux dont les emplois peuvent être reproduits par des robots – ne seront pas en mesure de se recycler pour d’autres types de travail sans un investissement important en temps et en efforts. »

Barry Chudakov, fondateur et directeur de Sertain Research, a commenté : » D’ici 2030, la collaboration homme-machine/AI sera un outil nécessaire pour gérer et contrer les effets de multiples accélérations simultanées : large avancée technologique, mondialisation, changement climatique et migrations mondiales qui en découlent. Par le passé, les sociétés humaines géraient le changement à l’aide de leurs tripes et de leur intuition, mais comme l’a déclaré Eric Teller, PDG de Google X, « nos structures sociétales ne parviennent pas à suivre le rythme du changement ». Pour suivre le rythme de ce changement et gérer une liste croissante de « problèmes difficiles » d’ici 2030, l’IA – ou, pour reprendre l’expression de Joi Ito, l’intelligence étendue – valorisera et réévaluera pratiquement tous les domaines du comportement et de l’interaction humains. L’IA et les technologies avancées modifieront notre cadre de réponse et nos délais (ce qui, à son tour, modifiera notre notion du temps). Alors que les interactions sociales se déroulaient autrefois dans des lieux précis (travail, école, église, environnement familial), elles se dérouleront de plus en plus en temps continu et simultané. Si nous avons de la chance, nous suivrons les 23 principes d’IA d’Asilomar décrits par le Future of Life Institute et travaillerons à « une intelligence non pas non dirigée mais bénéfique ». À l’instar de la dissuasion nucléaire découlant de la destruction mutuelle assurée, l’IA et les systèmes technologiques connexes constituent une force pour une renaissance morale. Nous devons embrasser cette renaissance morale, sinon nous serons confrontés à des énigmes morales qui pourraient entraîner la disparition de l’humanité. … Mon plus grand espoir en ce qui concerne la collaboration entre l’homme, la machine et l’IA constitue une renaissance morale et éthique – nous adoptons une mentalité de « moonshot » et verrouillons les bras pour nous préparer aux accélérations qui nous attendent. Ma plus grande crainte est que nous adoptions la logique de nos technologies émergentes – réponse instantanée, isolement derrière des écrans, comparaison sans fin de la valeur de soi, fausse présentation de soi – sans réfléchir ou répondre intelligemment. »

John C. Havens, directeur exécutif de l’IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems et du Council on Extended Intelligence, a écrit : « Aujourd’hui, en 2018, une majorité de personnes dans le monde ne peuvent pas accéder à leurs données, de sorte que toute discussion sur « l’augmentation humain-IA » ignore le contexte critique de qui contrôle réellement les informations et l’identité des gens. Bientôt, il sera extrêmement difficile d’identifier tout système autonome ou intelligent dont les algorithmes n’interagissent pas avec les données humaines sous une forme ou une autre. »

L’enjeu n’est rien de moins que le type de société dans laquelle nous voulons vivre et la façon dont nous faisons l’expérience de notre humanité.Batya Friedman

Batya Friedman, professeur d’interaction homme-machine à l’école d’information de l’université de Washington, a écrit : « Nos capacités scientifiques et technologiques ont dépassé et continueront de dépasser de loin nos capacités morales – c’est-à-dire notre capacité à utiliser avec sagesse et humanité les connaissances et les outils que nous développons. … La guerre automatisée – lorsque des armes autonomes tuent des êtres humains sans l’intervention de l’homme – peut conduire à une absence de responsabilité pour avoir ôté la vie à l’ennemi ou même à la connaissance que la vie d’un ennemi a été ôtée. L’enjeu n’est rien de moins que le type de société dans laquelle nous voulons vivre et la façon dont nous faisons l’expérience de notre humanité. »

Greg Shannon, scientifique en chef de la division CERT de l’université Carnegie Mellon, a déclaré : « Le meilleur/mauvais apparaîtra 4:1 avec le rapport à long terme 2:1. L’IA s’en sortira bien pour les travaux répétitifs où ‘proche’ sera suffisant et où les humains n’aiment pas ce travail. … La vie sera certainement meilleure, car l’IA prolonge la durée de vie, qu’il s’agisse d’applications de santé qui nous « poussent » intelligemment vers la santé, d’avertissements sur l’imminence d’un accident cardiaque ou d’un accident vasculaire cérébral, ou de soins de santé automatisés pour les personnes mal desservies (à distance) et celles qui ont besoin de soins prolongés (soins aux personnes âgées). Quant à la liberté, les risques sont évidents. L’IA affecte l’agence en créant des entités dotées de capacités intellectuelles significatives pour surveiller, faire respecter et même punir les individus. Ceux qui savent comment l’utiliser auront un pouvoir potentiel immense sur ceux qui ne savent pas ou ne peuvent pas le faire. Le bonheur futur n’est vraiment pas clair. Certains céderont leur agence à l’IA dans les jeux, le travail et la communauté, un peu comme la crise des opioïdes vole l’agence aujourd’hui. D’un autre côté, beaucoup seront libérés de tâches/emplois banals et peu engageants. Si des éléments du bonheur de la communauté font partie des fonctions objectives de l’IA, alors l’IA pourrait catalyser une explosion de bonheur. »

Kostas Alexandridis, auteur de « Exploring Complex Dynamics in Multi-agent-based Intelligent Systems », a prédit que « beaucoup de nos décisions quotidiennes seront automatisées avec une intervention minimale de l’utilisateur final. L’autonomie et/ou l’indépendance seront sacrifiées et remplacées par la commodité. Les nouvelles générations de citoyens deviendront de plus en plus dépendantes des structures et processus d’IA en réseau. Des défis doivent être relevés en termes de pensée critique et d’hétérogénéité. L’interdépendance en réseau va, plus que probablement, accroître notre vulnérabilité aux cyberattaques. Il est également fort probable qu’il existe des divisions plus marquées entre les « nantis » et les « démunis » du numérique, ainsi qu’entre les infrastructures numériques technologiquement dépendantes. Enfin, il y a la question des nouvelles ‘hauteurs de commandement’ de la propriété et du contrôle de l’infrastructure du réseau numérique. »

Oscar Gandy, professeur émérite de communication à l’Université de Pennsylvanie, a répondu : « Nous sommes déjà confrontés à une hypothèse non accordée lorsqu’on nous demande d’imaginer la ‘collaboration’ homme-machine. L’interaction est un peu différente, mais toujours entachée par l’octroi d’une forme d’identité – peut-être même d’un statut de personne – à des machines que nous utiliserons pour nous frayer un chemin à travers toutes sortes d’opportunités et de défis. Les problèmes auxquels nous serons confrontés à l’avenir sont assez semblables à ceux que nous rencontrons actuellement lorsque nous nous en remettons à « d’autres » (y compris les systèmes, dispositifs et réseaux technologiques) pour acquérir des choses que nous apprécions et éviter ces autres choses (dont nous pourrions, ou non, être conscients). »

James Scofield O’Rourke, professeur de gestion à l’université de Notre Dame, a déclaré : « La technologie a, tout au long de l’histoire enregistrée, été un concept largement neutre. La question de sa valeur a toujours dépendu de son application. Dans quel but l’IA et les autres avancées technologiques seront-elles utilisées ? Tout, de la poudre à canon aux moteurs à combustion interne en passant par la fission nucléaire, a été utilisé de manière utile ou destructrice. En supposant que nous puissions contenir ou contrôler l’IA (et non l’inverse), la réponse à la question de savoir si nous nous en sortirons mieux dépend entièrement de nous (ou de notre progéniture). ‘La faute, cher Brutus, n’est pas dans nos étoiles, mais en nous-mêmes, que nous sommes des sous-fifres' »

Simon Biggs, professeur d’arts interdisciplinaires à l’université d’Édimbourg, a déclaré : « L’IA fonctionnera pour augmenter les capacités humaines. Le problème ne vient pas de l’IA mais des humains. En tant qu’espèce, nous sommes agressifs, compétitifs et paresseux. Nous sommes également empathiques, soucieux de la communauté et (parfois) pleins d’abnégation. Nous avons de nombreux autres attributs. Ils seront tous amplifiés. Compte tenu des précédents historiques, on peut supposer que ce sont nos pires qualités qui seront amplifiées. Je m’attends à ce qu’en 2030, l’IA soit couramment utilisée pour mener des guerres et tuer des gens, bien plus efficacement que nous ne pouvons le faire actuellement. En tant que sociétés, nous serons moins affectés par cela que nous ne le sommes actuellement, car nous ne nous battrons pas et ne tuerons pas nous-mêmes. Notre capacité à modifier notre comportement, sous réserve de l’empathie et d’un cadre éthique associé, sera réduite par la dissociation entre notre action et l’acte de tuer. Nous ne pouvons pas attendre de nos systèmes d’IA qu’ils fassent preuve d’éthique en notre nom – ils ne le feront pas, car ils seront conçus pour tuer efficacement, et non de manière réfléchie. Mon autre préoccupation principale concerne la surveillance et le contrôle. L’avènement du système de crédit social (SCS) de la Chine est un indicateur de ce qui est susceptible d’arriver. Nous existerons au sein d’un SCS en tant qu’IA construisant des instances hybrides de nous-mêmes qui pourront ou non nous ressembler. Mais nos droits et nos possibilités en tant qu’individus seront déterminés par le SCS. C’est le cauchemar orwellien réalisé. »

Mark Surman, directeur exécutif de la Fondation Mozilla, a répondu : « L’IA continuera à concentrer le pouvoir et la richesse dans les mains de quelques grands monopoles basés aux États-Unis et en Chine. La plupart des gens – et certaines parties du monde – seront moins bien lotis. »

William Uricchio, spécialiste des médias et professeur d’études comparatives des médias au MIT, a commenté : « L’IA et ses applications connexes sont confrontées à trois problèmes : un développement à la vitesse de la loi de Moore, un développement aux mains d’une élite technologique et économique, et un développement sans bénéfice d’un public informé ou engagé. Le public est réduit à un collectif de consommateurs qui attendent la prochaine technologie. Quelle sera la notion de « progrès » qui prévaudra ? Nous avons de nombreuses preuves de l’utilisation de l’IA pour générer des profits, sans tenir compte des implications pour les valeurs de longue date, pour renforcer le contrôle gouvernemental et même pour évaluer le « crédit social » des citoyens sans l’apport des citoyens eux-mêmes. Comme les technologies qui l’ont précédée, l’IA est agnostique. Son déploiement est entre les mains de la société. Mais en l’absence d’un public familiarisé avec l’IA, la décision sur la meilleure façon de déployer l’IA reviendra à des intérêts particuliers. Cela signifie-t-il un déploiement équitable, l’amélioration de l’injustice sociale et l’IA dans le service public ? Parce que la réponse à cette question est sociale plutôt que technologique, je suis pessimiste. La solution ? Nous devons développer un public familiarisé avec l’IA, ce qui implique une attention particulière dans le secteur de l’éducation et dans les médias grand public. Nous devons assurer la diversité dans le développement des technologies de l’IA. Et jusqu’à ce que le public, ses représentants élus et leurs régimes juridiques et réglementaires puissent se mettre au diapason de ces évolutions rapides, nous devons faire preuve de prudence et de surveillance dans le développement de l’IA. »

Le reste de ce rapport est divisé en trois sections qui s’inspirent des espoirs et des observations critiques de centaines de répondants supplémentaires : 1) les préoccupations concernant l’évolution de l’homme et de l’IA, 2) les solutions suggérées pour faire face à l’impact de l’IA, et 3) les attentes de ce que sera la vie en 2030, y compris les perspectives positives des répondants sur la qualité de vie et l’avenir du travail, des soins de santé et de l’éducation. Certaines réponses sont légèrement modifiées pour des raisons de style.