La vita digitale sta aumentando le capacità umane e sconvolgendo attività umane millenarie. I sistemi guidati da codici si sono diffusi a più della metà degli abitanti del mondo nell’informazione e nella connettività ambientale, offrendo opportunità inimmaginate in precedenza e minacce senza precedenti. Mentre l’intelligenza artificiale (AI) emergente guidata da algoritmi continua a diffondersi, le persone staranno meglio di oggi?

Circa 979 pionieri della tecnologia, innovatori, sviluppatori, leader aziendali e politici, ricercatori e attivisti hanno risposto a questa domanda in un sondaggio di esperti condotto nell’estate del 2018.

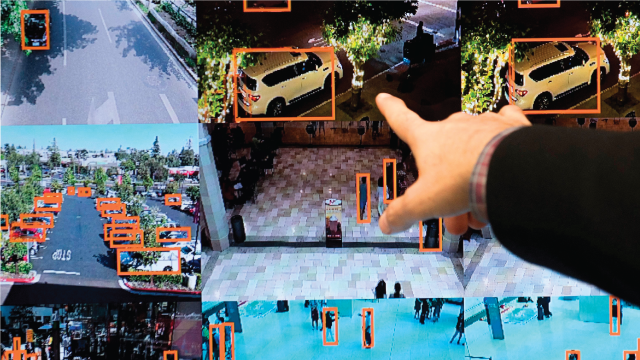

Gli esperti hanno previsto che l’intelligenza artificiale in rete amplificherà l’efficacia umana ma minaccerà anche l’autonomia, l’agenzia e le capacità umane. Hanno parlato delle possibilità ad ampio raggio; che i computer potrebbero eguagliare o addirittura superare l’intelligenza e le capacità umane su compiti come il complesso processo decisionale, il ragionamento e l’apprendimento, l’analitica sofisticata e il riconoscimento dei modelli, l’acutezza visiva, il riconoscimento vocale e la traduzione del linguaggio. Hanno detto che i sistemi “intelligenti” nelle comunità, nei veicoli, negli edifici e nei servizi, nelle fattorie e nei processi aziendali faranno risparmiare tempo, denaro e vite e offriranno opportunità per gli individui di godere di un futuro più personalizzato.

Molti hanno concentrato le loro osservazioni ottimistiche sull’assistenza sanitaria e sulle molte possibili applicazioni dell’IA nella diagnosi e nel trattamento dei pazienti o nell’aiutare gli anziani a vivere una vita più piena e più sana. Erano anche entusiasti del ruolo dell’IA nel contribuire ad ampi programmi di salute pubblica costruiti intorno a enormi quantità di dati che possono essere catturati nei prossimi anni su tutto, dai genomi personali alla nutrizione. Inoltre, un certo numero di questi esperti ha previsto che l’IA aiuterà i cambiamenti a lungo attesi nei sistemi di educazione formale e informale.

Tuttavia, la maggior parte degli esperti, indipendentemente dal fatto che siano ottimisti o meno, hanno espresso preoccupazioni circa l’impatto a lungo termine di questi nuovi strumenti sugli elementi essenziali dell’essere umano. A tutti gli intervistati in questo sondaggio non scientifico è stato chiesto di elaborare il motivo per cui ritenevano che l’IA avrebbe lasciato le persone in condizioni migliori o meno. Molti hanno condiviso profonde preoccupazioni, e molti hanno anche suggerito percorsi verso soluzioni. I temi principali che hanno suonato sulle minacce e i rimedi sono delineati nella tabella di accompagnamento.

AI e il futuro degli umani: Gli esperti esprimono preoccupazioni e suggeriscono soluzioni

| Caos: Armi autonome, criminalità informatica e informazioni armate |

Alcuni prevedono un’ulteriore erosione delle strutture sociopolitiche tradizionali e la possibilità di grandi perdite di vite umane a causa della crescita accelerata delle applicazioni militari autonome e l’uso di informazioni armate, bugie e propaganda per destabilizzare pericolosamente i gruppi umani. Alcuni temono anche la portata dei criminali informatici nei sistemi economici. | |

PEW RESEARCH CENTER AND ELON UNIVERSITY’S IMAGINING THE INTERNET CENTER

In particolare, ai partecipanti è stato chiesto di considerare quanto segue:

“Per favore pensate all’anno 2030. Gli analisti si aspettano che le persone diventeranno ancora più dipendenti dall’intelligenza artificiale (AI) in rete in complessi sistemi digitali. Alcuni dicono che continueremo sull’arco storico dell’aumento delle nostre vite con risultati per lo più positivi man mano che implementeremo ampiamente questi strumenti in rete. Alcuni dicono che la nostra crescente dipendenza da queste IA e dai sistemi correlati porterà probabilmente a difficoltà diffuse.

La nostra domanda: Entro il 2030, pensate che sia più probabile che l’avanzamento dell’IA e dei sistemi tecnologici correlati migliorerà le capacità umane e le potenzierà? Cioè, la maggior parte delle persone starà meglio di oggi? O è più probabile che l’avanzamento dell’IA e dei sistemi tecnologici correlati ridurrà l’autonomia e l’autonomia umana in misura tale che la maggior parte delle persone non starà meglio di come stanno oggi le cose?”

In generale, e nonostante i lati negativi che temono, il 63% degli intervistati in questo sondaggio ha detto di essere fiducioso che la maggior parte degli individui starà meglio nel 2030, e il 37% ha detto che la gente non starà meglio.

Un certo numero di leader di pensiero che hanno partecipato a questo sondaggio ha detto che la crescente dipendenza degli esseri umani dai sistemi tecnologici andrà bene solo se si presta molta attenzione a come questi strumenti, piattaforme e reti sono progettati, distribuiti e aggiornati. Alcune delle risposte potenti e generali includono quelle di:

Sonia Katyal, co-direttore del Berkeley Center for Law and Technology e membro del consiglio inaugurale del Dipartimento del Commercio degli Stati Uniti per l’economia digitale, ha previsto: “Nel 2030, la più grande serie di domande coinvolgerà come le percezioni dell’IA e la loro applicazione influenzerà la traiettoria dei diritti civili in futuro. Le domande sulla privacy, la parola, il diritto di riunione e la costruzione tecnologica della persona riemergeranno tutte in questo nuovo contesto di IA, mettendo in discussione le nostre convinzioni più profonde sull’uguaglianza e le opportunità per tutti. Chi beneficerà e chi sarà svantaggiato in questo nuovo mondo dipende da quanto ampiamente analizziamo queste domande oggi, per il futuro.”

Dobbiamo lavorare aggressivamente per assicurarci che la tecnologia corrisponda ai nostri valori.Erik Brynjolfsson

Erik Brynjolfsson, direttore della MIT Initiative on the Digital Economy e autore di “Machine, Platform, Crowd: Harnessing Our Digital Future”, ha detto: “L’IA e le tecnologie correlate hanno già raggiunto prestazioni sovrumane in molti settori, e ci sono pochi dubbi che le loro capacità miglioreranno, probabilmente in modo molto significativo, entro il 2030. … Penso che sia più probabile che useremo questo potere per rendere il mondo un posto migliore. Per esempio, possiamo virtualmente eliminare la povertà globale, ridurre massicciamente le malattie e fornire una migliore istruzione a quasi tutti sul pianeta. Detto questo, AI e ML possono anche essere usati per concentrare sempre più ricchezza e potere, lasciando molte persone indietro, e per creare armi ancora più orribili. Nessuno dei due risultati è inevitabile, quindi la domanda giusta non è “Cosa succederà?” ma “Cosa sceglieremo di fare? Dobbiamo lavorare in modo aggressivo per assicurarci che la tecnologia corrisponda ai nostri valori. Questo può e deve essere fatto a tutti i livelli, dal governo, al business, al mondo accademico, e alle scelte individuali.”

Bryan Johnson, fondatore e CEO di Kernel, uno sviluppatore leader di interfacce neurali avanzate, e OS Fund, una società di venture capital, ha detto: “Credo fortemente che la risposta dipende dal fatto che possiamo spostare i nostri sistemi economici verso la priorità del miglioramento umano radicale e frenare la tendenza verso l’irrilevanza umana di fronte alla IA. Non intendo solo posti di lavoro; intendo vera, esistenziale irrilevanza, che è il risultato finale di non dare priorità al benessere umano e alla cognizione.”

Marina Gorbis, direttore esecutivo dell’Institute for the Future, ha detto, “Senza cambiamenti significativi nella nostra economia politica e nei regimi di governance dei dati è probabile che si creino maggiori disuguaglianze economiche, più sorveglianza e più interazioni programmate e non umano-centriche. Ogni volta che programmiamo i nostri ambienti, finiamo per programmare noi stessi e le nostre interazioni. Gli esseri umani devono diventare più standardizzati, eliminando la serendipità e l’ambiguità dalle nostre interazioni. E questa ambiguità e complessità è ciò che è l’essenza dell’essere umano.”

Judith Donath, autore di “The Social Machine, Designs for Living Online” e membro di facoltà al Berkman Klein Center for Internet & Society dell’Università di Harvard, ha commentato: “Entro il 2030, la maggior parte delle situazioni sociali sarà facilitata da bot – programmi intelligenti che interagiscono con noi in modi simili agli umani. A casa, i genitori coinvolgeranno bot qualificati per aiutare i bambini con i compiti e catalizzare le conversazioni a cena. Al lavoro, i bot gestiranno le riunioni. Un bot confidente sarà considerato essenziale per il benessere psicologico, e ci rivolgeremo sempre più a questi compagni per consigli che vanno da cosa indossare a chi sposare. Noi umani ci preoccupiamo profondamente di come gli altri ci vedono – e gli altri di cui cerchiamo l’approvazione saranno sempre più spesso artificiali. Per allora, la differenza tra esseri umani e bot sarà molto più sfumata. Attraverso lo schermo e la proiezione, la voce, l’aspetto e i comportamenti dei bot saranno indistinguibili da quelli degli umani, e anche i robot fisici, sebbene ovviamente non umani, saranno così convincentemente sinceri che la nostra impressione di loro come esseri pensanti e sensibili, alla pari o superiori a noi, sarà incrollabile. Aggiungendo all’ambiguità, la nostra comunicazione sarà pesantemente aumentata: I programmi comporranno molti dei nostri messaggi e il nostro aspetto online/AR sarà computerizzato. (Il discorso e il contegno umano grezzo e non assistito sembreranno imbarazzantemente goffi, lenti e poco sofisticati). Aiutati dal loro accesso a grandi quantità di dati su ognuno di noi, i bot supereranno di gran lunga gli umani nella loro capacità di attrarre e persuadere. In grado di imitare le emozioni in modo esperto, non saranno mai sopraffatti dai sentimenti: Se sbottano qualcosa con rabbia, sarà perché quel comportamento è stato calcolato per essere il modo più efficace per avanzare qualsiasi obiettivo avessero “in mente”. Ma quali sono questi obiettivi? I compagni artificialmente intelligenti coltiveranno l’impressione che obiettivi sociali simili ai nostri li motivino – essere tenuti in buona considerazione, come un amico amato, un capo ammirato, ecc. Ma la loro vera collaborazione sarà con gli umani e le istituzioni che li controllano. Come i loro antenati di oggi, questi saranno i venditori di beni che li impiegano per stimolare il consumo e i politici che li incaricano di influenzare le opinioni.”

Andrew McLaughlin, direttore esecutivo del Center for Innovative Thinking all’Università di Yale, in precedenza vice direttore tecnologico degli Stati Uniti per il presidente Barack Obama e responsabile delle politiche pubbliche globali per Google, ha scritto: “Il 2030 non è lontano nel futuro. La mia sensazione è che le innovazioni come internet e l’IA in rete hanno enormi benefici a breve termine, insieme a negativi a lungo termine che possono richiedere decenni per essere riconoscibili. L’IA guiderà una vasta gamma di ottimizzazioni dell’efficienza, ma permetterà anche la discriminazione nascosta e la penalizzazione arbitraria degli individui in settori come l’assicurazione, la ricerca di lavoro e la valutazione delle prestazioni.”

Michael M. Roberts, primo presidente e CEO della Internet Corporation for Assigned Names and Numbers (ICANN) e membro della Internet Hall of Fame, ha scritto: “La gamma di opportunità per gli agenti intelligenti per aumentare l’intelligenza umana è ancora virtualmente illimitata. Il problema principale è che più un agente è conveniente, più ha bisogno di sapere di te – preferenze, tempi, capacità, ecc. – il che crea un compromesso tra più aiuto e più intrusione. Questa non è una questione in bianco e nero – le sfumature di grigio e i rimedi associati saranno discussi all’infinito. Il record fino ad oggi è che la convenienza prevale sulla privacy. Ho il sospetto che questo continuerà.”

danah Boyd, un ricercatore principale per Microsoft e fondatore e presidente del Data & Society Research Institute, ha detto: “L’IA è uno strumento che sarà usato dagli esseri umani per tutti i tipi di scopi, anche nella ricerca del potere. Ci saranno abusi di potere che coinvolgono l’IA, così come ci saranno progressi nella scienza e negli sforzi umanitari che coinvolgono anche l’IA. Sfortunatamente, ci sono alcune linee di tendenza che possono creare una massiccia instabilità. Prendiamo, per esempio, il cambiamento climatico e la migrazione climatica. Questo destabilizzerà ulteriormente l’Europa e gli Stati Uniti, e mi aspetto che, nel panico, vedremo l’IA essere usata in modi dannosi alla luce di altre crisi geopolitiche.”

Amy Webb, fondatore del Future Today Institute e professore di previsione strategica alla New York University, ha commentato: “Le strutture di sicurezza sociale attualmente in atto negli Stati Uniti e in molti altri paesi del mondo non sono state progettate per la nostra transizione all’IA. La transizione attraverso l’IA durerà i prossimi 50 anni o più. Mentre ci spostiamo più lontano in questa terza era dell’informatica, e mentre ogni singola industria diventa più profondamente radicata con i sistemi di IA, avremo bisogno di nuovi lavoratori della conoscenza con competenze ibride che possano operare in lavori che non hanno mai avuto bisogno di esistere prima. Avremo bisogno di agricoltori che sappiano lavorare con grandi serie di dati. Oncologi formati come robotocisti. Biologi formati come ingegneri elettrici. Non avremo bisogno di preparare la nostra forza lavoro solo una volta, con qualche modifica al curriculum. Man mano che l’IA matura, avremo bisogno di una forza lavoro reattiva, capace di adattarsi a nuovi processi, sistemi e strumenti ogni pochi anni. Il bisogno di questi campi sorgerà più velocemente di quanto i nostri dipartimenti del lavoro, le scuole e le università stiano riconoscendo. È facile guardare indietro alla storia attraverso la lente del presente – e trascurare i disordini sociali causati dalla diffusa disoccupazione tecnologica. Dobbiamo affrontare una verità difficile che pochi sono disposti a pronunciare ad alta voce: L’IA alla fine causerà un gran numero di persone che rimarranno permanentemente senza lavoro. Proprio come le generazioni precedenti hanno assistito a cambiamenti radicali durante e dopo la rivoluzione industriale, il rapido ritmo della tecnologia significherà probabilmente che i Baby Boomers e i membri più anziani della Gen X – specialmente quelli i cui lavori possono essere replicati dai robot – non saranno in grado di riqualificarsi per altri tipi di lavoro senza un significativo investimento di tempo e fatica.”

Barry Chudakov, fondatore e direttore di Sertain Research, ha commentato: “Entro il 2030 la collaborazione uomo-macchina/AI sarà uno strumento necessario per gestire e contrastare gli effetti di molteplici accelerazioni simultanee: ampio progresso tecnologico, globalizzazione, cambiamento climatico e relative migrazioni globali. In passato, le società umane hanno gestito il cambiamento attraverso l’istinto e l’intuizione, ma come ha detto Eric Teller, CEO di Google X, “Le nostre strutture sociali non riescono a tenere il passo con il ritmo del cambiamento”. Per tenere il passo con questo cambiamento e per gestire una lista crescente di “problemi malvagi” entro il 2030, l’IA – o usando la frase di Joi Ito, l’intelligenza estesa – valuterà e rivaluterà virtualmente ogni area del comportamento e dell’interazione umana. L’IA e le tecnologie che avanzano cambieranno il nostro quadro di risposta e i nostri tempi (che a sua volta, cambia il nostro senso del tempo). Dove una volta l’interazione sociale avveniva in luoghi – lavoro, scuola, chiesa, ambienti familiari – le interazioni sociali avverranno sempre più in tempo continuo e simultaneo. Se siamo fortunati, seguiremo i 23 Asilomar AI Principles delineati dal Future of Life Institute e lavoreremo verso “non un’intelligenza indiretta ma un’intelligenza benefica”. Come la deterrenza nucleare che deriva dalla distruzione reciproca assicurata, l’IA e i sistemi tecnologici correlati costituiscono una forza per una rinascita morale. Dobbiamo abbracciare questo rinascimento morale, o ci troveremo di fronte ad enigmi morali che potrebbero portare alla fine dell’umanità. … La mia più grande speranza per la collaborazione uomo-macchina/AI costituisce un rinascimento morale ed etico – adottiamo una mentalità da moonshot e chiudiamo le braccia per prepararci alle accelerazioni in arrivo. La mia più grande paura è che adottiamo la logica delle nostre tecnologie emergenti – risposta istantanea, isolamento dietro gli schermi, confronto infinito di autostima, finta presentazione di sé – senza pensare o rispondere in modo intelligente.”

John C. Havens, direttore esecutivo dell’IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems e del Council on Extended Intelligence, ha scritto: “Ora, nel 2018, la maggioranza delle persone in tutto il mondo non può accedere ai propri dati, quindi qualsiasi discussione sull'”aumento umano-AI” ignora il contesto critico di chi controlla effettivamente le informazioni e l’identità delle persone. Presto sarà estremamente difficile identificare qualsiasi sistema autonomo o intelligente i cui algoritmi non interagiscono con i dati umani in una forma o nell’altra.”

La posta in gioco è niente meno che il tipo di società in cui vogliamo vivere e come sperimentiamo la nostra umanità.Batya Friedman

Batya Friedman, professore di interazione uomo-computer all’Information School dell’Università di Washington, ha scritto: “Le nostre capacità scientifiche e tecnologiche hanno e continueranno a superare di gran lunga quelle morali – cioè la nostra capacità di usare saggiamente e umanamente la conoscenza e gli strumenti che sviluppiamo. … La guerra automatizzata – quando armi autonome uccidono esseri umani senza l’impegno umano – può portare a una mancanza di responsabilità per aver preso la vita del nemico o anche la conoscenza che la vita di un nemico è stata presa. In gioco c’è niente di meno che il tipo di società in cui vogliamo vivere e come sperimentiamo la nostra umanità.”

Greg Shannon, capo scienziato della divisione CERT alla Carnegie Mellon University, ha detto: “Meglio/peggio apparirà 4:1 con il rapporto a lungo termine 2:1. L’IA andrà bene per il lavoro ripetitivo dove ‘vicino’ sarà abbastanza buono e gli umani non amano il lavoro. … La vita sarà sicuramente migliore man mano che l’IA estenderà la durata della vita, dalle app per la salute che intelligentemente ci ‘spingono’ verso la salute, agli avvertimenti su eventi imminenti di cuore/ictus, all’assistenza sanitaria automatizzata per i meno serviti (a distanza) e quelli che hanno bisogno di assistenza estesa (assistenza agli anziani). Per quanto riguarda la libertà, ci sono chiari rischi. L’IA colpisce l’agenzia creando entità con capacità intellettuali significative per monitorare, far rispettare e persino punire gli individui. Quelli che sanno come usarla avranno un immenso potere potenziale su quelli che non lo fanno o non possono. La felicità futura è davvero poco chiara. Alcuni cederanno il loro potere all’IA nei giochi, nel lavoro e nella comunità, proprio come la crisi degli oppioidi ruba il potere oggi. D’altra parte, molti saranno liberati da compiti/lavori banali e poco impegnativi. Se gli elementi di felicità della comunità sono parte delle funzioni obiettivo dell’IA, allora l’IA potrebbe catalizzare un’esplosione di felicità.”

Kostas Alexandridis, autore di “Exploring Complex Dynamics in Multi-agent-based Intelligent Systems”, ha previsto: “Molte delle nostre decisioni quotidiane saranno automatizzate con un intervento minimo da parte dell’utente finale. L’autonomia e/o l’indipendenza saranno sacrificate e sostituite dalla comodità. Le nuove generazioni di cittadini diventeranno sempre più dipendenti da strutture e processi AI in rete. Ci sono sfide che devono essere affrontate in termini di pensiero critico ed eterogeneità. L’interdipendenza in rete aumenterà, molto probabilmente, la nostra vulnerabilità ai cyberattacchi. C’è anche una reale probabilità che esisteranno divisioni più nette tra “haves” e “have-nots” digitali, così come tra le infrastrutture digitali tecnologicamente dipendenti. Infine, c’è la questione delle nuove ‘altezze di comando’ della proprietà e del controllo dell’infrastruttura di rete digitale.”

Oscar Gandy, professore emerito di comunicazione all’Università della Pennsylvania, ha risposto: “Siamo già di fronte a un presupposto non concesso quando ci viene chiesto di immaginare la ‘collaborazione’ uomo-macchina. L’interazione è un po’ diversa, ma ancora macchiata dalla concessione di una forma di identità – forse persino di personalità – alle macchine che useremo per farci strada attraverso ogni sorta di opportunità e sfide. I problemi che affronteremo in futuro sono abbastanza simili ai problemi che affrontiamo attualmente quando ci affidiamo ad ‘altri’ (compresi i sistemi tecnologici, i dispositivi e le reti) per acquisire cose che apprezziamo ed evitare quelle altre cose (di cui potremmo, o non potremmo essere consapevoli).”

James Scofield O’Rourke, professore di management all’Università di Notre Dame, ha detto: “La tecnologia è stata, nel corso della storia registrata, un concetto ampiamente neutrale. La questione del suo valore è sempre dipesa dalla sua applicazione. Per quale scopo verranno utilizzati l’IA e altri progressi tecnologici? Tutto, dalla polvere da sparo ai motori a combustione interna alla fissione nucleare, è stato applicato sia in modo utile che distruttivo. Supponendo che possiamo contenere o controllare l’IA (e non il contrario), la risposta se staremo meglio dipende interamente da noi (o dalla nostra progenie). La colpa, caro Bruto, non è nelle nostre stelle, ma in noi stessi, che siamo subalterni”.”

Simon Biggs, professore di arti interdisciplinari all’Università di Edimburgo, ha detto: “L’IA funzionerà per aumentare le capacità umane. Il problema non è con l’IA ma con gli esseri umani. Come specie siamo aggressivi, competitivi e pigri. Siamo anche empatici, attenti alla comunità e (a volte) abnegati. Abbiamo molti altri attributi. Questi saranno tutti amplificati. Dati i precedenti storici, si dovrebbe supporre che saranno le nostre qualità peggiori ad essere amplificate. La mia aspettativa è che nel 2030 l’IA sarà usata di routine per combattere guerre e uccidere persone, molto più efficacemente di quanto possiamo uccidere attualmente. Come società saremo meno influenzati da questo come lo siamo attualmente, poiché non saremo noi stessi a combattere e uccidere. La nostra capacità di modificare il nostro comportamento, soggetto all’empatia e a un quadro etico associato, sarà ridotta dalla dissociazione tra la nostra agenzia e l’atto di uccidere. Non possiamo aspettarci che i nostri sistemi di IA siano etici per conto nostro – non lo saranno, poiché saranno progettati per uccidere in modo efficiente, non in modo ponderato. L’altra mia preoccupazione principale ha a che fare con la sorveglianza e il controllo. L’avvento del Sistema di Credito Sociale cinese (SCS) è un indicatore di ciò che probabilmente verrà. Esisteremo all’interno di un SCS come IA che costruisce istanze ibride di noi stessi che possono o non possono assomigliare a chi siamo. Ma i nostri diritti e le nostre possibilità come individui saranno determinati dall’SCS. Questo è l’incubo orwelliano realizzato.”

Mark Surman, direttore esecutivo della Mozilla Foundation, ha risposto: “L’IA continuerà a concentrare il potere e la ricchezza nelle mani di pochi grandi monopoli basati negli Stati Uniti e in Cina. La maggior parte delle persone – e parti del mondo – staranno peggio.”

William Uricchio, studioso di media e professore di studi comparati sui media al MIT, ha commentato: “L’IA e le sue applicazioni correlate affrontano tre problemi: sviluppo alla velocità della legge di Moore, sviluppo nelle mani di una élite tecnologica ed economica, e sviluppo senza beneficio di un pubblico informato o impegnato. Il pubblico è ridotto a un collettivo di consumatori in attesa della prossima tecnologia. Quale nozione di “progresso” prevarrà? Abbiamo ampie prove dell’uso dell’IA per guidare i profitti, senza tener conto delle implicazioni per i valori a lungo sostenuti; per migliorare il controllo governativo e persino segnare il “credito sociale” dei cittadini senza il contributo dei cittadini stessi. Come le tecnologie prima di essa, l’IA è agnostica. Il suo impiego è nelle mani della società. Ma in assenza di un pubblico alfabetizzato sull’IA, la decisione di come impiegare al meglio l’IA ricadrà su interessi speciali. Questo significherà una distribuzione equa, il miglioramento dell’ingiustizia sociale e l’IA nel servizio pubblico? Poiché la risposta a questa domanda è sociale piuttosto che tecnologica, sono pessimista. La soluzione? Dobbiamo sviluppare un pubblico alfabetizzato sull’IA, il che significa un’attenzione mirata nel settore educativo e nei media rivolti al pubblico. Dobbiamo assicurare la diversità nello sviluppo delle tecnologie AI. E fino a quando il pubblico, i suoi rappresentanti eletti e i loro regimi legali e normativi non saranno in grado di stare al passo con questi sviluppi in rapida evoluzione, dobbiamo esercitare cautela e supervisione nello sviluppo dell’IA.”

Il resto di questo rapporto è diviso in tre sezioni che attingono alle speranze e alle osservazioni critiche di centinaia di altri intervistati: 1) preoccupazioni sull’evoluzione uomo-IA, 2) soluzioni suggerite per affrontare l’impatto dell’IA, e 3) aspettative su come sarà la vita nel 2030, comprese le prospettive positive degli intervistati sulla qualità della vita e il futuro del lavoro, dell’assistenza sanitaria e dell’istruzione. Alcune risposte sono leggermente modificate per lo stile.