Viața digitală sporește capacitățile umane și perturbă activități umane vechi de eoni. Sistemele bazate pe coduri s-au răspândit la mai mult de jumătate din locuitorii lumii în materie de informații și conectivitate ambientală, oferind oportunități neimaginate anterior și amenințări fără precedent. Pe măsură ce inteligența artificială (AI) emergentă bazată pe algoritmi continuă să se răspândească, va fi mai bine pentru oameni decât este în prezent?

Un număr de 979 de pionieri în domeniul tehnologiei, inovatori, dezvoltatori, lideri din domeniul afacerilor și al politicilor, cercetători și activiști au răspuns la această întrebare în cadrul unui sondaj de opinie realizat în vara anului 2018.

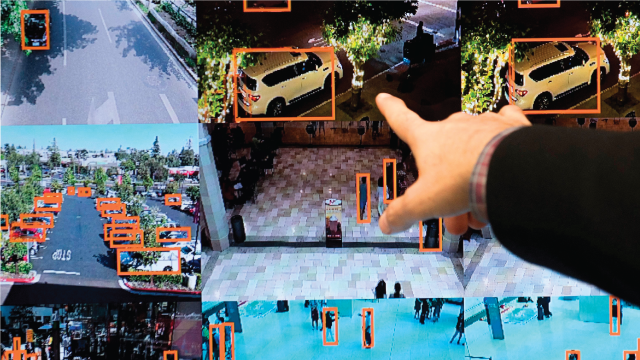

Experții au prezis că inteligența artificială în rețea va amplifica eficacitatea umană, dar va amenința, de asemenea, autonomia, agenția și capacitățile umane. Aceștia au vorbit despre posibilități extinse; faptul că computerele ar putea egala sau chiar depăși inteligența și capacitățile umane în sarcini precum luarea de decizii complexe, raționamentul și învățarea, analiza sofisticată și recunoașterea modelelor, acuitatea vizuală, recunoașterea vorbirii și traducerea limbilor. Aceștia au spus că sistemele „inteligente” din comunități, din vehicule, din clădiri și utilități, din ferme și din procesele de afaceri vor economisi timp, bani și vieți și vor oferi indivizilor oportunitatea de a se bucura de un viitor mai personalizat.

Mulți și-au concentrat remarcile optimiste asupra asistenței medicale și a numeroaselor aplicații posibile ale IA în diagnosticarea și tratarea pacienților sau în ajutarea persoanelor în vârstă să ducă o viață mai plină și mai sănătoasă. Ei au fost, de asemenea, entuziasmați cu privire la rolul AI de a contribui la programe ample de sănătate publică construite în jurul unor cantități masive de date care ar putea fi capturate în anii următori despre orice, de la genomul personal la nutriție. În plus, o parte dintre acești experți au prezis că IA va favoriza schimbări mult așteptate în sistemele educaționale formale și informale.

Totuși, majoritatea experților, indiferent dacă sunt sau nu optimiști, și-au exprimat îngrijorarea cu privire la impactul pe termen lung al acestor noi instrumente asupra elementelor esențiale ale ființei umane. Toți respondenții la acest sondaj neștiințific au fost rugați să explice mai detaliat de ce consideră că AI va lăsa oamenii mai bine sau nu. Mulți au împărtășit îngrijorări profunde și mulți au sugerat, de asemenea, căi spre soluții. Principalele teme pe care le-au sondat cu privire la amenințări și remedii sunt prezentate în tabelul alăturat.

AI și viitorul oamenilor: Experții își exprimă îngrijorările și sugerează soluții

| Haos: Arme autonome, criminalitate cibernetică și informații înarmate |

Câțiva prezic o erodare în continuare a structurilor sociopolitice tradiționale și posibilitatea unor pierderi mari de vieți omenești din cauza creșterii accelerate a aplicațiilor militare autonome și a utilizării informațiilor înarmate, a minciunilor și a propagandei pentru a destabiliza în mod periculos grupurile umane. Unii se tem, de asemenea, că infractorii cibernetici vor ajunge în sistemele economice. | |

PEW RESEARCH CENTER AND ELON UNIVERSITY’S IMAGINING THE INTERNET CENTER

În mod specific, participanților li s-a cerut să ia în considerare următoarele:

„Vă rugăm să vă gândiți la anul 2030. Analiștii se așteaptă ca oamenii să devină și mai dependenți de inteligența artificială (AI) în rețea în sistemele digitale complexe. Unii spun că vom continua pe arcul istoric de augmentare a vieților noastre cu rezultate în mare parte pozitive, pe măsură ce implementăm pe scară largă aceste instrumente în rețea. Alții spun că dependența noastră din ce în ce mai mare de aceste sisteme de inteligență artificială și sisteme conexe va duce probabil la dificultăți pe scară largă.

Întrebarea noastră: Până în 2030, credeți că este cel mai probabil ca avansarea IA și a sistemelor tehnologice conexe să sporească capacitățile umane și să le dea putere? Adică, în cea mai mare parte a timpului, majoritatea oamenilor vor fi mai bine decât sunt în prezent? Sau este cel mai probabil ca avansarea IA și a sistemelor tehnologice conexe să diminueze autonomia și agenția umană într-o asemenea măsură încât majoritatea oamenilor nu vor fi mai bine decât în prezent?”

În general, și în ciuda aspectelor negative de care se tem, 63% dintre respondenții la acest sondaj au declarat că sunt încrezători că majoritatea indivizilor vor fi în cea mai mare parte mai bine în 2030, iar 37% au spus că oamenii nu vor fi mai bine.

O parte dintre liderii de opinie care au participat la această sondare au declarat că dependența tot mai mare a oamenilor de sistemele tehnologice va merge bine numai dacă se acordă o atenție deosebită modului în care aceste instrumente, platforme și rețele sunt proiectate, distribuite și actualizate. Printre răspunsurile puternice și cuprinzătoare s-au numărat cele de la:

Sonia Katyal, co-director al Centrului Berkeley pentru Drept și Tehnologie și membru al consiliului inaugural de consilieri pentru economie digitală al Departamentului de Comerț al SUA, a prezis: „În 2030, cel mai mare set de întrebări va implica modul în care percepțiile privind IA și aplicarea lor vor influența traiectoria drepturilor civile în viitor. Întrebările privind viața privată, exprimarea, dreptul de întrunire și construcția tehnologică a personalității vor reapărea în acest nou context al IA, punând sub semnul întrebării cele mai profunde convingeri ale noastre privind egalitatea și oportunitățile pentru toți. Cine va beneficia și cine va fi dezavantajat în această nouă lume depinde de cât de larg analizăm aceste întrebări astăzi, pentru viitor.”

Trebuie să lucrăm agresiv pentru a ne asigura că tehnologia se potrivește cu valorile noastre.” Erik Brynjolfsson

Erik Brynjolfsson, director al MIT Initiative on the Digital Economy și autor al cărții „Machine, Platform, Crowd: Harnessing Our Digital Future”, a declarat: „Inteligența artificială și tehnologiile conexe au atins deja performanțe supraomenești în multe domenii și nu există nicio îndoială că capacitățile lor se vor îmbunătăți, probabil foarte mult, până în 2030. … Cred că este mai mult ca sigur că vom folosi această putere pentru a face lumea un loc mai bun. De exemplu, putem să eliminăm practic sărăcia globală, să reducem masiv bolile și să asigurăm o educație mai bună pentru aproape toată lumea de pe planetă. Acestea fiind spuse, AI și ML pot fi, de asemenea, folosite pentru a concentra din ce în ce mai mult bogăția și puterea, lăsând mulți oameni în urmă, și pentru a crea arme și mai îngrozitoare. Niciunul dintre cele două rezultate nu este inevitabil, așa că întrebarea corectă nu este „Ce se va întâmpla?”, ci „Ce vom alege să facem?”. Trebuie să lucrăm agresiv pentru a ne asigura că tehnologia corespunde valorilor noastre. Acest lucru poate și trebuie făcut la toate nivelurile, de la guvern, la afaceri, la mediul academic și la alegerile individuale.”

Bryan Johnson, fondator și director executiv al Kernel, un dezvoltator de top de interfețe neuronale avansate, și al OS Fund, o firmă de capital de risc, a declarat: „Cred cu tărie că răspunsul depinde de faptul dacă putem schimba sistemele noastre economice pentru a prioritiza îmbunătățirea radicală a oamenilor și pentru a stopa tendința de irelevanță umană în fața IA. Nu mă refer doar la locurile de muncă; mă refer la adevărata irelevanță existențială, care este rezultatul final al neacordării de prioritate bunăstării și cogniției umane.”

Marina Gorbis, director executiv al Institutului pentru viitor, a declarat: „Fără schimbări semnificative în economia noastră politică și în regimurile de guvernanță a datelor este probabil să se creeze inegalități economice mai mari, mai multă supraveghere și mai multe interacțiuni programate și necentrice față de om. De fiecare dată când ne programăm mediile, ajungem să ne programăm pe noi înșine și interacțiunile noastre. Oamenii trebuie să devină mai standardizați, eliminând serendipitatea și ambiguitatea din interacțiunile noastre. Iar această ambiguitate și complexitate reprezintă esența ființei umane.”

Judith Donath, autoarea cărții „The Social Machine, Designs for Living Online” (Mașina socială, modele pentru a trăi online) și membră a facultății de la Berkman Klein Center for Internet & Society de la Universitatea Harvard, a comentat: „Până în 2030, majoritatea situațiilor sociale vor fi facilitate de roboți – programe cu aparență inteligentă care interacționează cu noi în moduri asemănătoare cu cele umane. Acasă, părinții vor angaja roboți calificați pentru a-i ajuta pe copii la teme și pentru a cataliza conversațiile de la cină. La locul de muncă, roboții vor conduce ședințe. Un robot confident va fi considerat esențial pentru bunăstarea psihologică, iar noi vom apela din ce în ce mai mult la astfel de însoțitori pentru sfaturi, de la ce să purtăm până la cu cine să ne căsătorim. Noi, oamenii, ținem foarte mult la modul în care ne văd ceilalți – iar ceilalți a căror aprobare o căutăm vor fi din ce în ce mai mult artificiali. Până atunci, diferența dintre oameni și roboți se va fi estompat considerabil. Prin intermediul ecranului și al proiecției, vocea, înfățișarea și comportamentele roboților vor fi imposibil de distins de cele ale oamenilor și chiar și roboții fizici, deși evident non-umani, vor fi atât de convingător de sinceri, încât impresia noastră despre ei ca ființe care gândesc și simt, la egalitate cu noi sau superioare nouă, va fi de nezdruncinat. În plus față de această ambiguitate, propria noastră comunicare va fi puternic augmentată: Programele vor compune multe dintre mesajele noastre, iar aspectul nostru online/AR va fi creat prin calcul. (Vorbirea și comportamentul uman brut, fără ajutor, vor părea stânjenitor de greoaie, lente și nesofisticate). Ajutați de accesul lor la o mare cantitate de date despre fiecare dintre noi, roboții vor depăși cu mult oamenii în ceea ce privește capacitatea lor de a ne atrage și de a ne convinge. Capabile să imite cu măiestrie emoțiile, ei nu vor fi niciodată copleșiți de sentimente: Dacă vor spune ceva cu furie, va fi pentru că acel comportament a fost calculat pentru a fi cel mai eficient mod de a avansa obiectivele pe care le aveau „în minte”. Dar care sunt acele scopuri? Companionii inteligenți din punct de vedere artificial vor cultiva impresia că sunt motivați de scopuri sociale similare cu ale noastre – să fie ținuți în bună considerație, fie că este vorba de un prieten iubit, un șef admirat etc. Dar adevărata lor colaborare va fi cu oamenii și instituțiile care îi controlează. La fel ca strămoșii lor de astăzi, aceștia vor fi vânzători de bunuri care îi vor angaja pentru a stimula consumul și politicieni care îi vor însărcina să influențeze opiniile.”

Andrew McLaughlin, director executiv al Centrului pentru Gândire Inovativă de la Universitatea Yale, anterior adjunct al directorului adjunct pentru tehnologie din Statele Unite al președintelui Barack Obama și director de politici publice globale pentru Google, a scris: „2030 nu este un viitor îndepărtat. Părerea mea este că inovații precum internetul și inteligența artificială în rețea au beneficii masive pe termen scurt, alături de efecte negative pe termen lung care pot dura zeci de ani pentru a fi recunoscute. Inteligența artificială va conduce la o gamă vastă de optimizări ale eficienței, dar va permite, de asemenea, discriminarea ascunsă și penalizarea arbitrară a indivizilor în domenii precum asigurările, căutarea unui loc de muncă și evaluarea performanțelor.”

Michael M. Roberts, primul președinte și director executiv al Internet Corporation for Assigned Names and Numbers (ICANN) și membru al Internet Hall of Fame, a scris: „Gama de oportunități pentru ca agenții inteligenți să sporească inteligența umană este încă practic nelimitată. Problema majoră este că, cu cât un agent este mai convenabil, cu atât mai mult trebuie să știe mai multe despre dumneavoastră – preferințe, sincronizare, capacități etc. – ceea ce creează un compromis între mai mult ajutor și mai multă intruziune. Aceasta nu este o problemă în alb și negru – nuanțele de gri și remediile asociate vor fi discutate la nesfârșit. Până în prezent, se pare că confortul copleșește viața privată. Bănuiesc că acest lucru va continua.”

danah boyd, cercetător principal la Microsoft și fondator și președinte al Data & Society Research Institute, a declarat: „IA este un instrument care va fi folosit de oameni în tot felul de scopuri, inclusiv în căutarea puterii. Vor exista abuzuri de putere care implică IA, la fel cum vor exista progrese în știință și eforturi umanitare care vor implica, de asemenea, IA. Din păcate, există anumite linii de tendință care sunt susceptibile de a crea o instabilitate masivă. Să luăm, de exemplu, schimbările climatice și migrația climatică. Acest lucru va destabiliza și mai mult Europa și SUA și mă aștept ca, în panică, să vedem cum IA va fi folosită în moduri dăunătoare în lumina altor crize geopolitice.”

Amy Webb, fondator al Future Today Institute și profesor de previziune strategică la Universitatea din New York, a comentat: „Structurile de siguranță socială existente în prezent în SUA și în multe alte țări din lume nu au fost concepute pentru tranziția noastră către IA. Tranziția prin IA va dura următorii 50 de ani sau chiar mai mult. Pe măsură ce ne îndreptăm mai departe în această a treia eră a informaticii și pe măsură ce fiecare industrie în parte devine mai adânc înrădăcinată în sistemele de inteligență artificială, vom avea nevoie de noi lucrători cu competențe hibride în domeniul cunoașterii, care să poată opera în locuri de muncă care nu au mai fost necesare până acum. Vom avea nevoie de fermieri care să știe cum să lucreze cu seturi mari de date. Oncologi instruiți ca robotociști. Biologi instruiți ca ingineri electricieni. Nu va trebui să ne pregătim forța de muncă doar o singură dată, cu câteva modificări ale curriculumului. Pe măsură ce IA se maturizează, vom avea nevoie de o forță de muncă receptivă, capabilă să se adapteze la noi procese, sisteme și instrumente la fiecare câțiva ani. Nevoia pentru aceste domenii va apărea mai repede decât recunosc departamentele noastre de muncă, școlile și universitățile. Este ușor să privim istoria prin prisma prezentului – și să trecem cu vederea tulburările sociale provocate de șomajul tehnologic generalizat. Trebuie să abordăm un adevăr dificil pe care puțini sunt dispuși să îl rostească cu voce tare: Inteligența artificială va determina în cele din urmă ca un număr mare de oameni să rămână permanent fără loc de muncă. La fel cum generațiile anterioare au fost martorele unor schimbări radicale în timpul și în urma Revoluției Industriale, ritmul rapid al tehnologiei va însemna probabil că Baby Boomers și cei mai în vârstă membri ai Generației X – în special cei ale căror locuri de muncă pot fi replicate de roboți – nu vor putea să se recalifice pentru alte tipuri de muncă fără o investiție semnificativă de timp și efort.”

Barry Chudakov, fondator și director al Sertain Research, a comentat: „Până în 2030, colaborarea om-mașină/AI va fi un instrument necesar pentru a gestiona și contracara efectele multiplelor accelerări simultane: avansul tehnologic larg, globalizarea, schimbările climatice și migrațiile globale aferente. În trecut, societățile umane au gestionat schimbările prin instinct și intuiție, dar, după cum a declarat Eric Teller, CEO al Google X, „structurile noastre sociale nu reușesc să țină pasul cu ritmul schimbărilor”. Pentru a ține pasul cu această schimbare și pentru a gestiona o listă din ce în ce mai mare de „probleme dificile” până în 2030, IA – sau, folosind expresia lui Joi Ito, inteligența extinsă – va valoriza și revalorifica practic fiecare domeniu al comportamentului și interacțiunii umane. Inteligența artificială și tehnologiile avansate vor schimba cadrul nostru de răspuns și cadrele de timp (ceea ce, la rândul său, ne va schimba simțul timpului). Dacă odinioară interacțiunea socială se întâmpla în anumite locuri – la locul de muncă, la școală, la biserică, în mediul familial – interacțiunile sociale se vor petrece din ce în ce mai mult în timp continuu și simultan. Dacă suntem norocoși, vom urma cele 23 de principii Asilomar AI subliniate de Future of Life Institute și vom lucra în direcția „nu a unei inteligențe nemijlocite, ci a unei inteligențe benefice”. Asemănător cu descurajarea nucleară rezultată din distrugerea mutuală asigurată, IA și sistemele tehnologice conexe constituie o forță pentru o renaștere morală. Trebuie să îmbrățișăm această renaștere morală, altfel ne vom confrunta cu enigme morale care ar putea duce la dispariția omului. … Cea mai mare speranță a mea pentru colaborarea om-mașină/AI constituie o renaștere morală și etică – adoptăm o mentalitate de tip „Moonshot” și ne încleștăm pentru a ne pregăti pentru accelerările care vin spre noi. Cea mai mare teamă a mea este că adoptăm logica tehnologiilor noastre emergente – răspuns instantaneu, izolare în spatele ecranelor, comparație nesfârșită a valorii de sine, autoprezentare falsă – fără să gândim sau să răspundem inteligent.”

John C. Havens, director executiv al IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems (Inițiativa globală IEEE privind etica sistemelor autonome și inteligente) și al Council on Extended Intelligence (Consiliul pentru inteligență extinsă), a scris: „Acum, în 2018, majoritatea oamenilor din întreaga lume nu pot avea acces la datele lor, astfel încât orice discuții despre „mărirea numărului de oameni cu ajutorul IA” ignoră contextul critic al celui care controlează de fapt informațiile și identitatea oamenilor. În curând, va fi extrem de dificil să identificăm orice sistem autonom sau inteligent ai cărui algoritmi nu interacționează cu datele umane într-o formă sau alta.”

Miza nu este nimic mai puțin decât tipul de societate în care dorim să trăim și modul în care ne trăim umanitatea.Batya Friedman

Batya Friedman, profesor de interacțiune om-calculator la Școala de Informații a Universității din Washington, a scris: „Capacitățile noastre științifice și tehnologice le-au depășit și vor continua să le depășească cu mult pe cele morale – adică abilitatea noastră de a folosi cu înțelepciune și omenie cunoștințele și instrumentele pe care le dezvoltăm. … Războiul automatizat – atunci când armele autonome ucid ființe umane fără implicare umană – poate duce la o lipsă de responsabilitate în ceea ce privește luarea vieții inamicului sau chiar cunoașterea faptului că viața unui inamic a fost luată. Miza nu este nimic mai puțin decât în ce fel de societate vrem să trăim și cum ne trăim umanitatea.”

Greg Shannon, cercetător șef al diviziei CERT de la Universitatea Carnegie Mellon, a declarat: „Mai bine/mai rău va apărea 4:1, cu un raport pe termen lung de 2:1. Inteligența artificială se va descurca bine pentru munca repetitivă, unde „aproape” va fi suficient de bun, iar oamenilor nu le place munca. … Viața va fi cu siguranță mai bună pe măsură ce inteligența artificială prelungește durata de viață, de la aplicațiile de sănătate care ne „ghidează” în mod inteligent către sănătate, la avertismente despre evenimente iminente de infarct sau atac de cord, la asistența medicală automatizată pentru cei insuficient deserviți (la distanță) și pentru cei care au nevoie de îngrijire extinsă (îngrijirea bătrânilor). În ceea ce privește libertatea, există riscuri clare. Inteligența artificială afectează capacitatea de acțiune prin crearea unor entități cu capacități intelectuale semnificative pentru monitorizarea, aplicarea și chiar pedepsirea indivizilor. Cei care știu cum să o folosească vor avea o putere potențială imensă asupra celor care nu știu/nu pot. Fericirea viitoare este cu adevărat neclară. Unii își vor ceda agenția inteligenței artificiale în jocuri, muncă și comunitate, la fel cum criza opioidelor fură agenția astăzi. Pe de altă parte, mulți vor fi eliberați de sarcini/locuri de muncă banale și neimplicative. Dacă elemente ale fericirii comunității fac parte din funcțiile obiective ale IA, atunci IA ar putea cataliza o explozie a fericirii.”

Kostas Alexandridis, autorul cărții „Exploring Complex Dynamics in Multi-agent-based Intelligent Systems” (Explorarea dinamicii complexe în sistemele inteligente bazate pe agenți multipli), a prezis: „Multe dintre deciziile noastre de zi cu zi vor fi automatizate, cu o intervenție minimă din partea utilizatorului final. Autonomia și/sau independența vor fi sacrificate și înlocuite de comoditate. Noile generații de cetățeni vor deveni din ce în ce mai dependente de structurile și procesele de inteligență artificială în rețea. Există provocări care trebuie să fie abordate în ceea ce privește gândirea critică și eterogenitatea. Interdependența în rețea va crește, cel mai probabil, vulnerabilitatea noastră la atacurile cibernetice. Există, de asemenea, o probabilitate reală că vor exista diviziuni mai accentuate între „cei care au” și „cei care nu au” în domeniul digital, precum și între infrastructurile digitale dependente din punct de vedere tehnologic. În cele din urmă, se pune problema noilor „înălțimi de comandă” ale proprietății și controlului infrastructurii rețelelor digitale.”

Oscar Gandy, profesor emerit de comunicare la Universitatea din Pennsylvania, a răspuns: „Ne confruntăm deja cu o presupunere nepermisă atunci când ni se cere să ne imaginăm „colaborarea” om-mașină. Interacțiunea este un pic diferită, dar este încă viciată de acordarea unei forme de identitate – poate chiar de personalitate – mașinilor pe care le vom folosi pentru a ne croi drum printre tot felul de oportunități și provocări. Problemele cu care ne vom confrunta în viitor sunt destul de asemănătoare cu problemele cu care ne confruntăm în prezent atunci când ne bazăm pe „alții” (inclusiv sisteme, dispozitive și rețele tehnologice) pentru a dobândi lucruri pe care le prețuim și pentru a evita acele alte lucruri (de care am putea, sau nu, să fim conștienți).”

James Scofield O’Rourke, profesor de management la Universitatea Notre Dame, a declarat: „Tehnologia a fost, de-a lungul istoriei înregistrate, un concept în mare parte neutru. Problema valorii sale a fost întotdeauna dependentă de aplicarea sa. În ce scop vor fi folosite inteligența artificială și alte progrese tehnologice? Totul, de la praful de pușcă la motoarele cu combustie internă și până la fisiunea nucleară, a fost aplicat atât în moduri utile, cât și distructive. Presupunând că putem conține sau controla IA (și nu invers), răspunsul la întrebarea dacă ne va fi mai bine depinde în întregime de noi (sau de urmașii noștri). ‘Vina, dragă Brutus, nu este în stelele noastre, ci în noi înșine, că suntem subalterni.'”

Simon Biggs, profesor de arte interdisciplinare la Universitatea din Edinburgh, a declarat: „IA va funcționa pentru a spori capacitățile umane. Problema nu este cu IA, ci cu oamenii. Ca specie, suntem agresivi, competitivi și leneși. Suntem, de asemenea, empatici, cu spirit de comunitate și (uneori) sacrificați. Avem multe alte atribute. Toate acestea vor fi amplificate. Având în vedere precedentul istoric, ar trebui să presupunem că cele mai rele calități ale noastre vor fi cele care vor fi amplificate. Mă aștept ca în 2030 inteligența artificială să fie folosită în mod curent pentru a purta războaie și a ucide oameni, mult mai eficient decât putem ucide noi în prezent. Ca societăți, vom fi mai puțin afectați de acest lucru decât suntem în prezent, deoarece nu vom fi noi înșine cei care luptăm și ucidem. Capacitatea noastră de a ne modifica comportamentul, sub rezerva empatiei și a unui cadru etic asociat, va fi redusă prin disocierea dintre agenția noastră și actul de a ucide. Nu ne putem aștepta ca sistemele noastre de inteligență artificială să fie etice în numele nostru – nu vor fi, deoarece vor fi concepute pentru a ucide în mod eficient, nu în mod conștient. Cealaltă preocupare principală a mea este legată de supraveghere și control. Apariția sistemului de credit social al Chinei (SCS) este un indicator a ceea ce va urma probabil. Vom exista în cadrul unui SCS ca instanțe hibride ale inteligenței artificiale care pot sau nu să semene cu noi înșine. Dar drepturile și facilitățile noastre ca indivizi vor fi determinate de SCS. Acesta este coșmarul orwellian realizat.”

Mark Surman, director executiv al Fundației Mozilla, a răspuns: „IA va continua să concentreze puterea și bogăția în mâinile câtorva mari monopoluri bazate pe SUA și China. Cei mai mulți oameni – și părți ale lumii – vor avea o situație mai proastă.”

William Uricchio, cercetător media și profesor de studii media comparative la MIT, a comentat: „IA și aplicațiile sale conexe se confruntă cu trei probleme: dezvoltarea cu viteza Legii lui Moore, dezvoltarea în mâinile unei elite tehnologice și economice și dezvoltarea fără a beneficia de un public informat sau implicat. Publicul este redus la un colectiv de consumatori care așteaptă următoarea tehnologie. A cui noțiune de „progres” va prevala? Avem numeroase dovezi că inteligența artificială este folosită pentru a obține profituri, fără a ține cont de implicațiile asupra valorilor de lungă durată; pentru a spori controlul guvernamental și chiar pentru a puncta „creditul social” al cetățenilor fără contribuția cetățenilor înșiși. La fel ca tehnologiile care au precedat-o, IA este agnostică. Implementarea sa se află în mâinile societății. Dar, în absența unui public care să cunoască inteligența artificială, decizia cu privire la modul cel mai bun de desfășurare a inteligenței artificiale va cădea în sarcina unor interese speciale. Va însemna aceasta o utilizare echitabilă, ameliorarea nedreptății sociale și utilizarea inteligenței artificiale în serviciul public? Deoarece răspunsul la această întrebare este mai degrabă social decât tehnologic, sunt pesimist. Soluția? Trebuie să dezvoltăm un public care să cunoască inteligența artificială, ceea ce înseamnă o atenție sporită în sectorul educațional și în mass-media orientată către public. Trebuie să asigurăm diversitatea în dezvoltarea tehnologiilor IA. Și până când publicul, reprezentanții săi aleși și regimurile lor juridice și de reglementare se vor putea pune la curent cu aceste evoluții rapide, trebuie să dăm dovadă de prudență și să supraveghem dezvoltarea IA.”

Rămășița acestui raport este împărțită în trei secțiuni care se bazează pe observațiile pline de speranță și critice ale altor sute de respondenți: 1) preocupări cu privire la evoluția dintre oameni și IA, 2) soluții sugerate pentru a aborda impactul IA și 3) așteptări cu privire la ceea ce va fi viața în 2030, inclusiv perspectivele pozitive ale respondenților cu privire la calitatea vieții și la viitorul muncii, al asistenței medicale și al educației. Unele răspunsuri sunt ușor editate din motive de stil.

.