デジタルライフは、人間の能力を増強し、何世紀にもわたる人間の活動を破壊している。 コード駆動システムは、アンビエントな情報と接続性において、世界の住人の半分以上に広がり、以前には想像もつかなかった機会と前例のない脅威を提供しています。 新興のアルゴリズム駆動型人工知能(AI)が普及し続ける中、人々は今よりも良い生活を送れるでしょうか?

2018年夏に実施した専門家の聞き取り調査で、約979人のテクノロジー先駆者、革新者、開発者、ビジネスおよび政策のリーダー、研究者、活動家がこの質問に答えました。

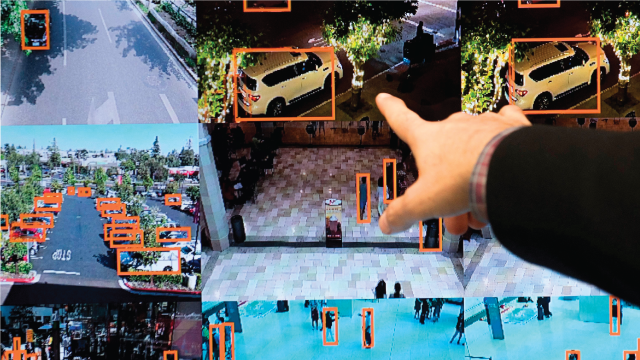

専門家はネットワーク型人工知能が人間の効果を増幅する一方で、人間の自律性や代理性、能力も脅かすと予測しています。 彼らは幅広い可能性について語った;複雑な意思決定、推論と学習、高度な分析とパターン認識、視力、音声認識、言語翻訳などのタスクについて、コンピューターが人間の知性と能力に匹敵するか、それを超えるかもしれないと述べたのだ。 コミュニティ、自動車、建物、公共施設、農場、ビジネス プロセスにおける「スマート」なシステムは、時間、お金、命を節約し、個人がよりカスタマイズされた未来を楽しむ機会を提供すると、彼らは述べました。 彼らはまた、個人のゲノムから栄養まで、今後数年間で取得される可能性のある膨大な量のデータを基に構築される広範な公衆衛生プログラムに貢献するAIの役割についても熱狂的でした。 さらに、これらの専門家の多くは、AI が、公式および非公式の教育システムにおいて、長い間予期されていた変化を助長すると予測していました。

しかし、楽観的かどうかにかかわらず、ほとんどの専門家は、これらの新しいツールが人間としての本質的要素に与える長期的影響について懸念を表明していました。 この非科学的な聞き取り調査では、すべての回答者に、AI によって人々がより良くなると感じる理由、あるいはそうでないと感じる理由について詳しく尋ねました。 多くの人が深い悩みを共有し、また多くの人が解決への道筋を提案した。 脅威と解決策について彼らが鳴らした主なテーマは、添付の表にまとめられています。

AIと人間の未来。 専門家は懸念を表明し、解決策を提案する

| Mayhem: Autonomous weapons, cybercrime and weaponized information |

Autonomous military applications と weaponized information, lies and propaganda to destabilizing human groups の加速的成長により、従来の社会政治的構造がさらに侵食されて、大きな生命喪失の可能性になることを予見する人もいます。 また、サイバー犯罪者が経済システムにまで手を伸ばすことを恐れる人もいます。 | |

PEW RESEARCH CENTER AND ELON UNIVERSITY’S IMAGINING THE INTERNET CENTER

具体的には、参加者に次のことを検討してもらいました:

「2030年に向かって考えてください」。 アナリストは、人々は複雑なデジタル システムにおけるネットワーク化された人工知能(AI)への依存度がさらに高くなると予想しています。 これらのネットワーク化されたツールを広く導入することで、私たちの生活を増大させ、ほぼ肯定的な結果をもたらすという歴史的な弧を歩み続けるだろうと言う人もいます。 また、これらのAIや関連システムへの依存度が高まることで、困難が広まる可能性が高いと言う人もいます。

私たちの質問です。 2030年までに、進歩するAIと関連する技術システムが人間の能力を高め、力を与える可能性が最も高いと思いますか? つまり、ほとんどの人が今より良くなるのでしょうか? それとも、AIや関連する技術システムの進歩によって、人間の自律性や主体性が弱まり、ほとんどの人が今日よりも良い暮らしができなくなる可能性が最も高いでしょうか」

全体として、また彼らが恐れるマイナス面にもかかわらず、この聞き取り調査では63%の回答者が、2030年にはほとんどの個人の暮らしが良くなると期待していると答え、37%の人は良くならないだろうと答えています。

この聞き取り調査に参加した多くの思想家は、人間の技術システムへの依存の拡大は、これらのツール、プラットフォーム、ネットワークがどのように設計、配布、更新されるかに細心の注意を払わないとうまくいかないだろうと述べています。 4594>

Sonia Katyal(バークレー法律技術センター共同ディレクター、米国商務省デジタル経済諮問委員会初代メンバー)は、「2030年、最大の問題は、AIとその応用に対する認識が、将来の市民権の軌道にどのように影響するかに関わるだろう」と予測しました。 プライバシー、言論、集会権、人間性の技術的構築に関する問題はすべて、この新しいAIの文脈で再浮上し、万人のための平等と機会に関する私たちの最も深い信念に疑問を投げかけるだろう。 この新しい世界で誰が利益を得、誰が不利益を被るかは、今日、未来のために、これらの問題をどれだけ幅広く分析するかにかかっています」

テクノロジーが私たちの価値観に合うように、積極的に取り組む必要があります」

エリック ブリンジョルフソン MIT デジタル経済イニシアチブ ディレクター、「マシン、プラットフォーム、クラウド」著者のErik Brynjolfsson氏は、次のように述べています。 Harnessing Our Digital Future」の著者で、「AIと関連技術はすでに多くの分野で超人的なパフォーマンスを達成しており、2030年までにその能力が、おそらく非常に大きく向上することは間違いない。 … 私は、この力を使って世界をより良い場所にする可能性が高いと思います。 例えば、世界の貧困を事実上なくし、病気を大量に減らし、地球上のほぼすべての人によりよい教育を提供できるようになります。 しかし、AIやMLは、富や権力の集中が進み、多くの人が置き去りにされたり、より恐ろしい兵器を作り出すために使われる可能性もあります。 どちらの結果も必然ではないので、正しい問いは「何が起こるか」ではなく、「何を選択するか」です。 私たちは、テクノロジーが私たちの価値観と一致するように、積極的に働きかける必要があります。 これは、政府、企業、学界、そして個人の選択に至るまで、あらゆるレベルで行うことができ、また行わなければなりません」

先進的なニューラル・インターフェースの開発をリードするカーネルと、ベンチャーキャピタルであるOSファンドの創業者でCEOのブライアン・ジョンソンは、「答えは、経済システムを、根本的に人間の向上を優先させ、AIに直面して人間が無関係となる傾向を食い止める方向にシフトできるかどうかにかかっていると強く信じています」と述べています。 私は、単なる仕事という意味ではなく、人間の幸福と認知を優先しないことの最終結果である、真の実存的な無関係を意味しています」

未来研究所のエグゼクティブ・ディレクター、マリーナ・ゴービス氏は、「政治経済とデータの統治体制に大きな変化がなければ、経済的不平等の拡大、監視強化、プログラムによる人間中心ではない相互関係の増加が生じるでしょう」と述べています。 私たちが環境をプログラムするたびに、結局は自分自身と相互作用をプログラムすることになるのです。 人間はより標準化され、相互作用からセレンディピティとあいまいさを取り除かなければならない。 そして、この曖昧さと複雑さこそが、人間であることの本質なのです」

「The Social Machine, Designs for Living Online」の著者で、ハーバード大学バークマンクラインセンター・フォー・インターネット&ソサエティーの教授フェロー、Judith Donath氏は、「2030年までに、ほとんどの社会状況はボットに促進されるだろう-人間のように対話する知的な外観を持ったプログラムによって」とコメントしています。 家庭では、親が熟練したボットを使って子供の宿題を手伝ったり、夕食の会話を弾ませたりするようになるでしょう。 仕事では、ボットが会議を進行します。 心理的な安らぎを得るためには、ボットのような親友が不可欠であり、私たちは、服装から結婚相手に至るまで、ボットにアドバイスを求めるようになるでしょう。 私たち人間は、他人が自分をどう見ているかということをとても気にします。そして、私たちが承認を求める他人は、ますます人工的になっていくでしょう。 その頃には、人間とボットの違いはかなりぼやけていることでしょう。 スクリーンやプロジェクションによって、ボットの声、外見、振る舞いは人間と区別がつかなくなり、物理的なロボットも、明らかに人間ではないにもかかわらず、説得力のある誠実さで、私たちと同等かそれ以上の、考え、感じる存在としての印象が揺らぐことはないだろう。 さらに曖昧さを増すのは、私たち自身のコミュニケーションが大幅に拡張されることだ。 プログラムは私たちのメッセージの多くを構成し、私たちのオンライン/ARの外観は計算機によって作り出されるでしょう。 (人間の生の会話や態度は、恥ずかしくなるほど不格好で、遅く、洗練されていないように見えるだろう)。 ボットは、私たち一人ひとりに関する膨大なデータへのアクセスによって、私たちを惹きつけ、説得する能力において、人間をはるかに凌駕することになるでしょう。 感情を巧みに模倣することができるため、感情に打ち負かされることはないでしょう。 もし、彼らが怒りに任せて何かをぶちまけたとしても、それは、彼らが「考えている」目標を達成するために、その行動が最も効果的な方法であると計算されているからでしょう。 しかし、その目標とは何だろうか? 人工知能を持った仲間は、私たちと同じような社会的目標が彼らを動かしているという印象を植え付けるだろう–最愛の友人、賞賛される上司など、良い評価を受けることだ。 しかし、彼らの本当の共同作業は、彼らをコントロールする人間や組織と行われるでしょう。 今日の先達と同様に、消費を刺激するために彼らを雇う商品の売り手や、意見を動かすために彼らに依頼する政治家がそうなるでしょう」

Andrew McLaughlin, the Center for Innovative Thinking at Yale University の執行ディレクター、以前は Barack Obama 大統領の米国副技術責任者やGoogle のグローバル公共政策リードは、「2030年は遠い未来ではありません」と書いています。 私の感覚では、インターネットやネットワーク型AIのようなイノベーションは、認識できるまでに数十年かかるような長期的なマイナス面とともに、短期的に巨額の利益をもたらすと思います。 AIは、膨大な範囲の効率最適化を推進しますが、保険、求職、業績評価などの分野で、個人に対する隠れた差別や恣意的なペナルティを可能にします」

Michael M. Roberts, Internet Corporation for Assigned Names and Numbers (ICANN) の初代社長兼CEOでインターネットの殿堂メンバー、「知的エージェントが人間の知能を増強できる範囲はまだほぼ無限にあります」と書いています。 大きな問題は、エージェントが便利になればなるほど、あなたのこと(好み、タイミング、能力など)を知る必要があることだ。 – これは、より多くの手助けがより多くの侵入を必要とするというトレードオフを生み出します。 これは白黒の問題ではなく、グレーの濃淡や関連する救済策については、果てしなく議論が続くでしょう。 これまでの記録では、利便性がプライバシーを圧倒している。 マイクロソフトの主席研究員で、データ&ソサエティ研究所の創設者兼社長のダナ・ボイド氏は、「AIは、権力の追求を含むあらゆる目的のために人間によって使われる道具です。 AIが関与する権力の乱用があるのと同様に、AIも関与する科学の進歩や人道的取り組みもあるでしょう。 しかし、残念ながら、ある種のトレンドラインは、大規模な不安定さを生み出す可能性があります。 例えば、気候変動と気候変動による移住です。 これは欧州と米国をさらに不安定にするでしょうし、パニック状態において、他の地政学的危機に照らして、AIが有害な方法で使われるのを見ることになると思います」

Future Today Instituteの創設者でニューヨーク大学戦略先見教授であるAmy Webb氏は、「現在米国や世界の多くの国で行われている社会安全網構造は、我々のAIへの移行に向けて設計されていませんでした」とコメントしている。 AIによる移行は、今後50年以上続くでしょう。 この第3のコンピューティングの時代へとさらに進み、あらゆる産業がAIシステムをより深く浸透させるようになると、これまで存在する必要のなかった仕事で活動できる新しいハイブリッドスキルの知識労働者が必要になります。 ビッグデータセットの扱い方を知っている農家が必要になるだろう。 ロボトシストとして訓練された腫瘍学者。 電気技師としての訓練を受けた生物学者。 私たちは、カリキュラムを少し変更するだけで、労働力を準備する必要はないでしょう。 AIが成熟するにつれ、数年ごとに新しいプロセス、システム、ツールに適応できる、即応性のある労働力が必要になります。 こうした分野のニーズは、労働省や学校、大学が認識しているよりも早く発生することでしょう。 現在というレンズを通して歴史を振り返ることは簡単で、技術的な失業の蔓延がもたらす社会不安を見過ごすこともできます。 私たちは、声を大にして言う人がほとんどいない難しい真実に取り組む必要があるのです。 AIはいずれ、多くの人々を永久に失業させることになるでしょう。 前の世代が産業革命の最中やその後に大きな変化を目撃したように、テクノロジーの急速な進歩は、ベビーブーマーやX世代の高齢者、特にロボットに仕事を奪われた人々が、時間と労力をかけずに他の種類の仕事に再就職することができなくなることを意味するだろう。”

Sertain Researchの創設者兼代表のBarry Chudakov氏は、「2030年までに、人間と機械とAIのコラボレーションは、幅広いテクノロジーの進歩、グローバル化、気候変動、それに伴う世界規模の移住という、複数の同時加速の影響を管理し対抗するための必須ツールとなるだろう」とコメントしている。 これまで人間社会は、直感と根性で変化を管理してきましたが、Google XのCEOであるエリック・テラー氏は、『我々の社会構造は、変化のスピードについていけなくなっている』と述べています」。 その変化に対応し、2030年までに増え続ける『邪悪な問題』を管理するために、AI、あるいは伊藤穰一の言葉を借りれば拡張知能は、人間の行動と相互作用のほぼすべての領域に価値を与え、再評価することになるでしょう。 AIと進化するテクノロジーは、私たちの対応の枠組みや時間軸を変えるでしょう(その結果、私たちの時間感覚も変わることになります)。 かつて社会的相互作用は、職場、学校、教会、家庭環境といった場所で起こっていましたが、社会的相互作用はますます連続的で同時的な時間で起こるようになることでしょう。 幸運にも、Future of Life Instituteがまとめた23のAsilomar AI Principlesに従い、「無指向性知能ではなく、有益な知能」を目指していくことになるのだろう。 相互確証破壊に由来する核抑止力と同様に、AIと関連する技術システムは道徳的なルネッサンスのための力を構成します。 私たちはその道徳的ルネッサンスを受け入れなければ、人類の滅亡をもたらしかねない道徳的難問に直面することになる。 私たちはムーンショットのような考え方を取り入れ、加速する事態に備えるために手を携えるのです。 私が最も恐れているのは、私たちが賢く考えたり対応したりすることなく、新興テクノロジーの論理、すなわち即座の応答、スクリーンの向こうの孤立、自己価値の果てしない比較、偽りの自己呈示を採用することです。 Havens氏(IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems and the Council on Extended Intelligenceのエグゼクティブディレクター)は、「2018年の今、世界中の大多数の人が自分のデータにアクセスできないので、どんな『人間-AIオーグメンテーション』の議論も、誰が実際に人々の情報とアイデンティティを管理しているかという重要な文脈を無視しています」と書きました。 まもなく、アルゴリズムが何らかの形で人間のデータと相互作用しない自律型または知的システムを特定することは極めて困難になるでしょう」

問題になっているのは、私たちがどんな社会に住みたいのか、私たちの人間性をどう体験するのかということに他なりません。ワシントン大学情報学部の人間とコンピュータの相互作用の教授であるバティア・フリードマンは、「私たちの科学技術的能力は、道徳的能力、つまり、私たちが開発した知識やツールを賢く人道的に使用する能力をはるかに上回り、今後もそうなり続けるでしょう」と書いています。 自動化された戦争、すなわち自律型兵器が人間の関与なしに人間を殺す場合、敵の命を奪ったことに対する責任が欠如し、敵の命が奪われたことを知ることさえできなくなる可能性がある。 危機に瀕しているのは、私たちがどのような社会で生きたいか、私たちが人間性をどのように経験するかということにほかなりません」

カーネギーメロン大学CERT部門チーフサイエンティストのグレッグ・シャノン氏は、「よりよいものと悪いものが4:1に現れ、長期的には2:1の割合になるでしょう」と述べている。 AIは『近い』でよく、人間が嫌がるような反復的な作業をうまくこなすだろう。 AIによって寿命が延び、健康への知的な「後押し」をする健康アプリから、心臓や脳卒中の危険が迫っていることを知らせる警告、十分なサービスを受けていない人(遠隔)や長期の介護が必要な人(老人介護)のための自動医療まで、生活は確実に良くなるだろう。 自由に関しては、明確なリスクがある。 AIは、個人を監視し、強制し、さらには罰するための有意義な知的能力を持つ実体を作り出すことで、エージェンシーに影響を与える。 その使い方を知っている人は、そうでない人/そうでない人に対し、計り知れない潜在的な力を持つことになる。 未来の幸せは本当に不透明です。 今日のオピオイド危機が代理権を奪うように、ゲームや仕事、コミュニティでAIに代理権を譲り渡す人も出てくるでしょう。 一方で、多くの人が、平凡でやる気のない仕事・作業から解放されるでしょう。 コミュニティの幸福の要素が AIの目的関数に含まれるなら、AIは幸福の爆発を触媒することができます」

Kostas Alexandridis、「マルチエージェント ベースのインテリジェント システムにおける複雑なダイナミクスの探求」の著者は、「我々の日々の決定の多くは、エンドユーザーによる最小限の介入で自動化されるだろう」と予測しました。 自律性や独立性が犠牲になり、利便性に取って代わられるだろう。 新しい世代の市民は、ネットワーク化されたAIの構造やプロセスにますます依存するようになるだろう。 クリティカルシンキングと異質性という点で対処すべき課題がある。 ネットワーク化された相互依存は、より一層、サイバー攻撃に対する脆弱性を高めるでしょう。 また、デジタルの「持つ者」と「持たざる者」の間や、技術的に依存するデジタルインフラの間に、より鮮明な分断が存在する可能性が現実味を帯びてきます。 最後に、デジタル ネットワーク インフラストラクチャの所有権と管理権の新しい「司令塔」についての問題があります」

ペンシルベニア大学コミュニケーション学部名誉教授オスカー ガンディーは、「人間と機械の『コラボレーション』を想像するよう求められるとき、私たちはすでに付与されない仮定に直面しています」と答えています。 インタラクションは少し違いますが、それでも、私たちがあらゆる機会や課題を乗り越えるために使うであろう機械に、ある種のアイデンティティ、もしかしたら人間らしささえも付与してしまうことに汚染されているのです。 私たちが将来直面する問題は、私たちが価値あるものを獲得するために「他者」(技術システム、装置、ネットワークを含む)に依存し、(私たちが意識するかもしれない、あるいは意識しないかもしれない)それらの他のものを回避するときに、現在直面している問題と非常に似ています」

James Scofield O’Rourke, University of Notre Dame の経営教授は、「テクノロジーは記録に残る歴史を通じて、ほぼ中立的概念でした」と述べています。 その価値を問うのは、常にその応用に依存してきた。 AIをはじめとする技術の進歩は、どのような目的のために使われるのか。 火薬から内燃機関、核分裂に至るまで、あらゆるものが有益にも破壊的にも応用されてきた。 私たちがAIを封じ込め、コントロールできると仮定すれば(その逆ではなく)、私たちがより良い生活を送れるかどうかは、すべて私たち(あるいは私たちの子孫)にかかっているのです。 親愛なるブルータスよ、悪いのは星ではなく、私たちが下っ端であること、私たち自身にあるのだ」

エディンバラ大学の学際芸術の教授、サイモン・ビッグスは、「AIは人間の能力を増強するために機能するだろう」と述べています。 問題はAIにではなく、人間にある。 種として私たちは攻撃的で、競争的で、怠惰である。 また、共感的で、コミュニティを大切にし、(時には)自己犠牲的でもある。 その他にも多くの属性を持っています。 これらはすべて増幅されるでしょう。 歴史的な前例から考えると、増幅されるのは私たちの最悪の性質であると考えなければならないでしょう。 私の予想では、2030年にはAIが日常的に戦争に参加し、現在私たちが殺しているよりもはるかに効果的に人を殺すようになると思います。 社会としては、自分たちで戦争や殺人をするわけではないので、現在のように影響を受けることはないでしょう。 共感とそれに伴う倫理的枠組みを条件として、私たちの行動を修正する能力は、私たちの行為主体と殺人の行為との間の分離によって低下することになるでしょう。 AIシステムが私たちに代わって倫理的であることを期待することはできません。なぜなら、AIシステムは思慮深くなく、効率的に殺すように設計されているからです。 もうひとつの大きな懸念は、監視と管理に関するものです。 中国の社会的信用システム(SCS)の出現は、今後起こり得ることの指標となります。 私たちは、SCSの中で、AIが構築するハイブリッドな自分自身のインスタンスとして存在することになります。 しかし、私たちの個人としての権利と権限は、SCSによって決定されるでしょう。 これはオーウェルの悪夢の実現です」

Mozilla Foundationのエグゼクティブ・ディレクター、マーク・サーマン氏は、「AIは、米国と中国を拠点とする少数の大独占企業の手に、権力と富を集中させ続けるでしょう」と回答しています。 ほとんどの人々、そして世界の一部は、より悪い状況に陥るだろう」

William Uricchio(メディア学者、MIT比較メディア学教授)は、「AIとその関連アプリケーションは、ムーアの法則の速度での開発、技術・経済エリートの手による開発、情報提供や関与する一般の人々の利益にならない開発という3つの問題に直面している」とコメントした。 一般市民は、次のテクノロジーを待つ消費者の集団に成り下がっている。 誰の「進歩」の概念が優先されるのだろうか? 私たちは、長年の価値観への影響に関係なく、利益を上げるためにAIが使用されていること、政府の管理を強化するため、さらには市民自身の意見なしに市民の「社会的信用」を評価するために使用されていることを十分に証明している。 以前のテクノロジーと同様、AIは不可知論者である。 その導入は社会の手に委ねられている。 しかし、AIに精通した国民がいなければ、AIをどのように配備するのがベストなのか、その判断は特別な利害関係者に委ねられることになる。 これは、公平な配置、社会的不公正の改善、公共サービスにおけるAIを意味するのだろうか? この問いに対する答えは、技術的というよりも社会的なものなので、私は悲観的に考えています。 解決策は? AIに精通した国民を育てる必要があります。これは、教育部門や一般向けのメディアで重点的に注意を払うことを意味します。 AI技術の開発には、多様性を確保する必要があります。 そして、一般市民、選出された代表者、法律および規制体制が、これらの動きの速い開発に対応できるようになるまで、AIの開発には注意と監視が必要です」

このレポートの残りの部分は、何百人もの追加回答者の希望に満ちた、批判的観測から得られた3つのセクションに分けられています。 1)人間とAIの進化に関する懸念、2)AIの影響に対処するための解決策の提案、3)生活の質、仕事、医療、教育の将来に対する回答者の前向きな見通しを含む、2030年の生活がどのようになるかの期待です。 文体の都合上、一部の回答は軽く編集しています

。