- Apprentissage non supervisé

- Agorithmes d’apprentissage non supervisé

- Exemple d’apprentissage automatique non supervisé

- Pourquoi l’apprentissage non supervisé ?

- Types d’apprentissage non supervisé

- Clustering

- Exclusif (partitionnement)

- Agglomératifs

- Overlapping

- Probabiliste

- Types de regroupement

- Groupement hiérarchique :

- K-means Clustering

- Clustering agglomérant:

- Dendrogramme:

- K- Plus proches voisins

- Analyse en composantes principales:

- Association

- Apprentissage supervisé vs. Apprentissage automatique non supervisé

- Applications de l’apprentissage automatique non supervisé

- Inconvénients de l’apprentissage non supervisé

- Sommaire

Apprentissage non supervisé

L’apprentissage non supervisé est une technique d’apprentissage automatique dans laquelle les utilisateurs n’ont pas besoin de superviser le modèle. Au lieu de cela, il permet au modèle de travailler par lui-même pour découvrir des modèles et des informations qui n’étaient pas détectés auparavant. Elle traite principalement les données non étiquetées.

Agorithmes d’apprentissage non supervisé

Les algorithmes d’apprentissage non supervisé permettent aux utilisateurs d’effectuer des tâches de traitement plus complexes par rapport à l’apprentissage supervisé. Bien que l’apprentissage non supervisé puisse être plus imprévisible par rapport aux autres méthodes d’apprentissage naturel. Les algorithmes d’apprentissage non supervisé comprennent le regroupement, la détection d’anomalies, les réseaux neuronaux, etc.

Dans ce tutoriel, vous apprendrez :

- Exemple d’apprentissage automatique non supervisé

- Pourquoi l’apprentissage non supervisé ?

- Types d’apprentissage non supervisé

- Regroupement

- Types de regroupement

- Association

- Apprentissage automatique supervisé vs. Apprentissage automatique non supervisé

- Applications de l’apprentissage automatique non supervisé

- Inconvénients de l’apprentissage non supervisé

Exemple d’apprentissage automatique non supervisé

Prenons, le cas d’un bébé et du chien de sa famille.

Elle connaît et identifie ce chien. Quelques semaines plus tard, un ami de la famille amène un chien et essaie de jouer avec le bébé.

Le bébé n’a pas vu ce chien auparavant. Mais elle reconnaît que de nombreuses caractéristiques (2 oreilles, yeux, marche sur 4 pattes) sont comme son chien de compagnie. Elle identifie le nouvel animal comme un chien. Il s’agit d’un apprentissage non supervisé, où l’on ne vous apprend pas mais vous apprenez à partir des données (dans ce cas, des données sur un chien.) Si cela avait été un apprentissage supervisé, l’ami de la famille aurait dit au bébé que c’est un chien.

Pourquoi l’apprentissage non supervisé ?

Voici, les raisons principales pour utiliser l’apprentissage non supervisé :

- L’apprentissage automatique non supervisé trouve toutes sortes de modèles inconnus dans les données.

- Les méthodes non supervisées vous aident à trouver des caractéristiques qui peuvent être utiles pour la catégorisation.

- Il se déroule en temps réel, donc toutes les données d’entrée à analyser et à étiqueter en présence des apprenants.

- Il est plus facile d’obtenir des données non étiquetées à partir d’un ordinateur que des données étiquetées, qui nécessitent une intervention manuelle.

Types d’apprentissage non supervisé

Les problèmes d’apprentissage non supervisé sont en outre regroupés en problèmes de regroupement et d’association.

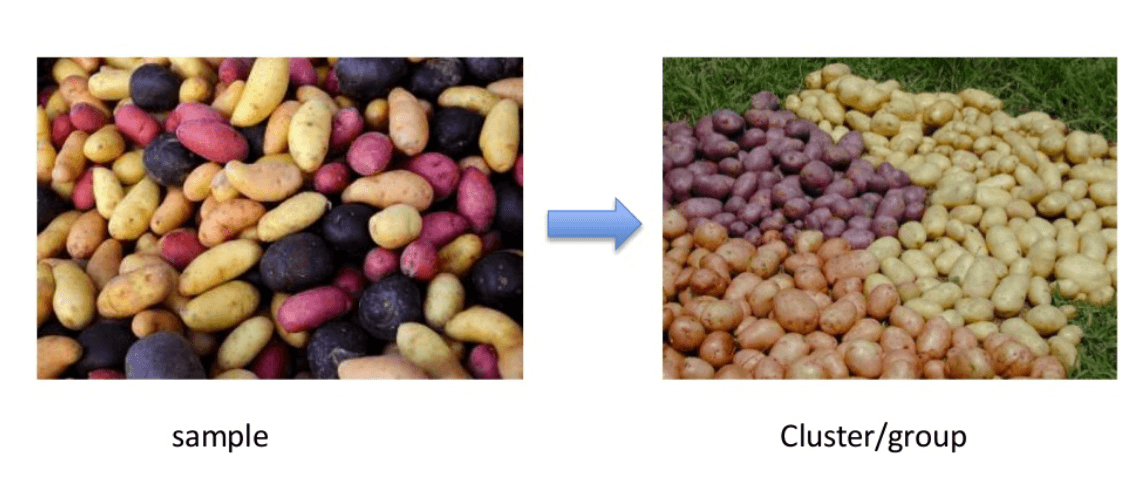

Clustering

Le clustering est un concept important lorsqu’il s’agit d’apprentissage non supervisé. Il s’agit principalement de trouver une structure ou un modèle dans une collection de données non catégorisées. Les algorithmes de clustering vont traiter vos données et trouver des clusters(groupes) naturels s’ils existent dans les données. Vous pouvez également modifier le nombre de clusters que vos algorithmes doivent identifier. Cela vous permet d’ajuster la granularité de ces groupes.

Il existe différents types de clustering que vous pouvez utiliser :

Exclusif (partitionnement)

Dans cette méthode de clustering, les données sont regroupées de telle sorte qu’une donnée ne peut appartenir qu’à un seul cluster.

Exemple : K-means

Agglomératifs

Dans cette technique de clustering, chaque donnée est un cluster. Les unions itératives entre les deux clusters les plus proches réduisent le nombre de clusters.

Exemple : Le clustering hiérarchique

Overlapping

Dans cette technique, les ensembles flous sont utilisés pour regrouper les données. Chaque point peut appartenir à deux ou plusieurs clusters avec des degrés d’appartenance distincts.

Ici, les données seront associées à une valeur d’appartenance appropriée. Exemple : Fuzzy C-Means

Probabiliste

Cette technique utilise la distribution de probabilité pour créer les clusters

Exemple : Les mots-clés suivants

- « chaussure d’homme. »

- « chaussure de femme. »

- « gant de femme. »

- « gant d’homme. »

peuvent être regroupés en deux catégories « chaussure » et « gant » ou « homme » et « femmes ».

Types de regroupement

- Groupement hiérarchique

- Groupement K-means

- K-NN (k plus proches voisins)

- Analyse en composantes principales

- Décomposition en valeur singulière

- Analyse en composantes indépendantes

Groupement hiérarchique :

Le clustering hiérarchique est un algorithme qui construit une hiérarchie de clusters. Il commence par toutes les données qui sont affectées à un cluster qui leur est propre. Ici, deux clusters proches vont être dans le même cluster. Cet algorithme se termine lorsqu’il ne reste plus qu’un seul cluster.

K-means Clustering

K signifie que c’est un algorithme de clustering itératif qui vous aide à trouver la valeur la plus élevée pour chaque itération. Initialement, le nombre souhaité de clusters est sélectionné. Dans cette méthode de clustering, vous devez regrouper les points de données en k groupes. Un k plus grand signifie des groupes plus petits avec plus de granularité de la même manière. Un k plus faible signifie des groupes plus grands avec moins de granularité.

La sortie de l’algorithme est un groupe d' »étiquettes ». Il affecte le point de données à l’un des k groupes. Dans le clustering k-means, chaque groupe est défini en créant un centroïde pour chaque groupe. Les centroïdes sont comme le cœur du cluster, qui capture les points les plus proches d’eux et les ajoute au cluster.

Le clustering K-mean définit en outre deux sous-groupes :

- Clustering agglomérant

- Dendrogramme

Clustering agglomérant:

Ce type de clustering K-means commence avec un nombre fixe de clusters. Il répartit toutes les données dans le nombre exact de clusters. Cette méthode de clustering ne nécessite pas le nombre de clusters K comme entrée. Le processus d’agglomération commence par former chaque donnée comme un seul cluster.

Cette méthode utilise une certaine mesure de distance, réduit le nombre de clusters (un à chaque itération) par un processus de fusion. Finalement, nous avons un grand cluster qui contient tous les objets.

Dendrogramme:

Dans la méthode de clustering par dendrogramme, chaque niveau va représenter un cluster possible. La hauteur du dendrogramme montre le niveau de similarité entre deux clusters joints. Plus ils sont proches du bas du processus, plus le cluster est similaire, ce qui est la découverte du groupe à partir du dendrogramme qui n’est pas naturel et surtout subjectif.

K- Plus proches voisins

K- plus proches voisins est le plus simple de tous les classificateurs d’apprentissage machine. Il diffère des autres techniques d’apprentissage automatique, en ce sens qu’il ne produit pas de modèle. C’est un algorithme simple qui stocke tous les cas disponibles et classe les nouvelles instances en fonction d’une mesure de similarité.

Il fonctionne très bien lorsqu’il y a une distance entre les exemples. La vitesse d’apprentissage est lente lorsque l’ensemble d’entraînement est grand, et le calcul de la distance n’est pas trivial.

Analyse en composantes principales:

Dans le cas où vous voulez un espace à plus haute dimension. Vous devez sélectionner une base pour cet espace et seulement les 200 scores les plus importants de cette base. Cette base est connue comme une composante principale. Le sous-ensemble que vous sélectionnez constitue un nouvel espace qui est de petite taille par rapport à l’espace original. Il conserve autant que possible la complexité des données.

Association

Les règles d’association permettent d’établir des associations entre les objets de données à l’intérieur de grandes bases de données. Cette technique non supervisée consiste à découvrir des relations intéressantes entre des variables dans de grandes bases de données. Par exemple, les personnes qui achètent une nouvelle maison sont plus susceptibles d’acheter de nouveaux meubles.

Autres exemples :

- Un sous-groupe de patients cancéreux groupés par leurs mesures d’expression génique

- Groupes d’acheteurs basés sur leurs historiques de navigation et d’achat

- Groupe de films par la notation donnée par les spectateurs de films

Apprentissage supervisé vs. Apprentissage automatique non supervisé

| Paramètres | Technique d’apprentissage automatique supervisé | Technique d’apprentissage automatique non supervisé |

| Données d’entrée | Les algorithmes sont entraînés en utilisant des données étiquetées. | Les algorithmes sont utilisés contre des données qui ne sont pas étiquetées |

| Computational Complexity | L’apprentissage supervisé est une méthode plus simple. | L’apprentissage non supervisé est complexe sur le plan informatique |

| Haute précision | Méthode très précise et digne de confiance. | Méthode moins précise et digne de confiance. |

Applications de l’apprentissage automatique non supervisé

Certaines applications des techniques d’apprentissage automatique non supervisé sont :

- Le clustering divise automatiquement l’ensemble de données en groupes basés sur leurs similarités

- La détection d’anomalies peut découvrir des points de données inhabituels dans votre ensemble de données. Elle est utile pour trouver des transactions frauduleuses

- L’exploration d’association identifie des ensembles d’éléments qui apparaissent souvent ensemble dans votre ensemble de données

- Les modèles de variables latentes sont largement utilisés pour le prétraitement des données. Comme la réduction du nombre de caractéristiques dans un ensemble de données ou la décomposition de l’ensemble de données en plusieurs composants

Inconvénients de l’apprentissage non supervisé

- Vous ne pouvez pas obtenir des informations précises concernant le tri des données, et la sortie car les données utilisées dans l’apprentissage non supervisé sont étiquetées et non connues

- Moins de précision des résultats est parce que les données d’entrée ne sont pas connues et non étiquetées par des personnes à l’avance. Cela signifie que la machine nécessite de le faire elle-même.

- Les classes spectrales ne correspondent pas toujours aux classes informationnelles.

- L’utilisateur doit passer du temps à interpréter et à étiqueter les classes qui suivent cette classification.

- Les propriétés spectrales des classes peuvent également changer dans le temps, de sorte que vous ne pouvez pas avoir la même information de classe en passant d’une image à l’autre.

Sommaire

- L’apprentissage non supervisé est une technique d’apprentissage automatique, où vous n’avez pas besoin de superviser le modèle.

- L’apprentissage automatique non supervisé vous aide à trouver toutes sortes de modèles inconnus dans les données.

- Le clustering et l’association sont deux types d’apprentissage non supervisé.

- Quatre types de méthodes de clustering sont 1) exclusives 2) agglomératives 3) superposées 4) probabilistes.

- Les types de clustering importants sont : 1)Le clustering hiérarchique 2) Le clustering K-means 3) K-NN 4) L’analyse en composantes principales 5) La décomposition en valeurs singulières 6) L’analyse en composantes indépendantes.

- Les règles d’association permettent d’établir des associations entre les objets de données à l’intérieur de grandes bases de données.

- Dans l’apprentissage supervisé, les algorithmes sont formés en utilisant des données étiquetées tandis que dans l’apprentissage non supervisé, les algorithmes sont utilisés contre des données qui ne sont pas étiquetées.

- La détection d’anomalies peut découvrir des points de données importants dans votre ensemble de données, ce qui est utile pour trouver des transactions frauduleuses.

- Le plus grand inconvénient de l’apprentissage non supervisé est que vous ne pouvez pas obtenir des informations précises concernant le tri des données.