- 教師なし学習

- 教師なし学習アルゴリズム

- 教師なし機械学習の例

- なぜ教師なし学習なのか

- 教師なし学習の種類

- クラスタリング

- 排他的(パーティショニング)

- Agglomerative

- 重複

- Probabilistic

- Probabilistic

- クラスタリングの種類

- Hierarchical Clustering:

- K-means Clustering

- Agglomerative clustering:

- デンドログラム:

- K- 最近傍

- 主成分分析:

- Association

- Supervised vs. Unservised。 教師なし機械学習

- 教師なし機械学習の応用

- 教師なし学習のデメリット

- 概要 教師なし学習は、モデルを監視する必要がない機械学習手法です。 教師なし学習にはクラスタリングとアソシエーションがある。 クラスタリングの方法には、1)排他的 2)凝集的 3)重複 4)確率的 の4種類がある。 1)階層的クラスタリング 2)K-meansクラスタリング 3)K-NN4)主成分分析 5)特異値分解 6)独立成分分析 関連規則により、大規模データベース内のデータオブジェクト間の関連付けを確立することができる。 教師あり学習では、ラベル付けされたデータを使用してアルゴリズムを学習させますが、教師なし学習では、ラベル付けされていないデータに対してアルゴリズムを使用します。 異常検出は、データセット内の重要なデータポイントを発見することができ、不正取引の発見に有効です。

教師なし学習

教師なし学習とは、ユーザーがモデルを監督する必要がない機械学習手法です。 その代わり、モデルが自ら働いて、以前は検出されなかったパターンや情報を発見することができます。 主にラベル付けされていないデータを扱う。

教師なし学習アルゴリズム

教師なし学習アルゴリズムにより、教師あり学習と比較して、より複雑な処理タスクを実行することができます。 しかし、教師なし学習は、他の自然学習法と比較して、より予測不可能である可能性がある。 教師なし学習アルゴリズムには、クラスタリング、異常検出、ニューラルネットワークなどがある。

このチュートリアルでは、次のことを学びます。

- 教師なし機械学習の例

- なぜ教師なし学習なのか?

- 教師なし学習の種類

- クラスタリング

- クラスタリングの種類

- 関連付け

- Supervised vs. Unsupervised Machine Learning? 教師なし機械学習

- 教師なし機械学習の応用

- 教師なし学習のデメリット

教師なし機械学習の例

赤ちゃんとその家の犬のケースで考えてみましょう。

彼女はこの犬を知っており、識別しています。 数週間後、家族の友人が犬を連れてきて、赤ちゃんと遊ぼうとします。

赤ちゃんはこの犬を以前に見たことがありません。 しかし、多くの特徴(2つの耳、目、4本足で歩くこと)が彼女のペットの犬に似ていることを認識します。 彼女はこの新しい動物を犬として識別します。 これは教師なし学習で、教えられるのではなく、データ(この場合は犬に関するデータ)から学習します。もしこれが教師あり学習であれば、家族の友人が赤ちゃんに「これは犬だ」と教えたことでしょう。

なぜ教師なし学習なのか

教師なし学習を使う主な理由は以下のとおりです。

- 教師なし機械学習は、データ内のあらゆる種類の未知のパターンを見つけます。

- 教師なし学習はリアルタイムで行われるため、すべての入力データを分析し、学習者の存在下でラベルを付けることができます。

教師なし学習の種類

教師なし学習問題は、さらにクラスタリング問題と関連付け問題に分類される。

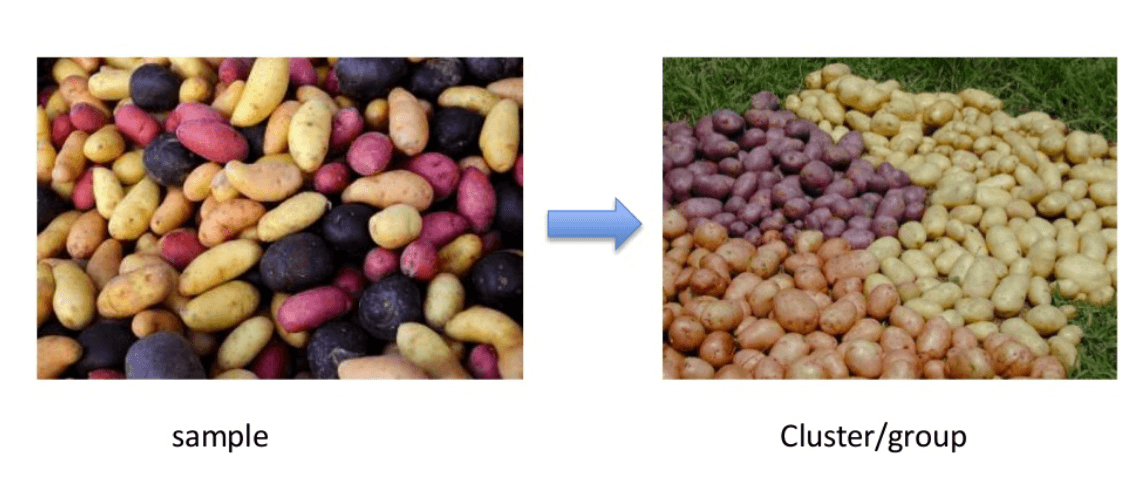

クラスタリング

クラスタリングは教師なし学習に関して重要な概念である。 これは主に、分類されていないデータのコレクションから構造やパターンを見つけることを扱います。 クラスタリング アルゴリズムは、データを処理し、データ内に自然なクラスタ (グループ) が存在する場合、それを見つけます。 また、アルゴリズムが識別すべきクラスタの数を変更することもできます。 これらのグループの粒度を調整することができます。 利用できるクラスタリングにはさまざまな種類があります。

排他的(パーティショニング)

このクラスタリング方法では、1 つのデータが 1 つのクラスターにのみ属することができるように、データをグループ化します。

例: K-means

Agglomerative

このクラスタリング手法では、すべてのデータが1つのクラスタとなります。 2つの最も近いクラスタ間の反復的な結合により、クラスタ数を減らすことができる。

例: 階層的クラスタリング

重複

この手法では、ファジーセットを使用してデータをクラスタリングします。 各ポイントは、別々のメンバーシップを持つ2つ以上のクラスタに属することができる。

ここで、データは適切なメンバーシップ値と関連付けられます。 例 ファジーC-Means

Probabilistic

この手法は、クラスタを作成するために確率分布を使用します

例.Fuzzy C-Means

Probabilistic

クラスタを作成するために確率分布を使用します。

- “男の靴”

- “女の靴”

- “女の手袋”

- “男の手袋”

は “shoe” と “glove” または “man” と “women” に分類される可能性が高いです。

クラスタリングの種類

- Hierarchical clustering

- K-means clustering

- K-NN (k nearest neighbors)

- Principal Component Analysis

Hierarchical Clustering:

Hierarchical clustering は、クラスタの階層を構築するアルゴリズムです。 それは彼ら自身のクラスタに割り当てられているすべてのデータで始まります。 ここで、2つの近いクラスタは同じクラスタに入ることになる。 このアルゴリズムは、クラスタが1つだけになった時点で終了する。

K-means Clustering

K は反復クラスタリングアルゴリズムであり、反復ごとに最高値を見つけるのに役立つことを意味します。 最初に、クラスタの所望の数が選択されます。 このクラスタリング法では、データポイントを k グループにクラスタリングする必要があります。 k が大きければ大きいほど、同じように粒度の細かいグループになることを意味します。 kが小さいほど、粒度の小さい大きなグループを意味します。

アルゴリズムの出力は、”ラベル “のグループです。 これは、データポイントをkグループの1つに割り当てます。 k-meansクラスタリングでは、各グループのセントロイドを作成することによって、各グループが定義されます。 セントロイドはクラスタの心臓のようなもので、それに近い点を捉えてクラスタに加える。

K-mean clusteringでは、さらに2つのサブグループを定義する。

- Agglomerative clustering

- Dendrogram

Agglomerative clustering:

このタイプの K-means clustering は固定数のクラスターで開始されます。 それはクラスタの正確な数にすべてのデータを割り当てる。 このクラスタリング法は、入力としてクラスタ数Kを必要としない。 凝集処理は、各データを1つのクラスタとして形成することから始まる。

この方法では、何らかの距離尺度を用いて、クラスタ数を減らし(各反復で1クラスタ)、マージ処理を行う。 最後に、すべてのオブジェクトを含む1つの大きなクラスタができる。

デンドログラム:

デンドログラムクラスタリング法では、各レベルは可能なクラスターを表します。 デンドログラムの高さは、2つの結合クラスタ間の類似性のレベルを示しています。 これは、デンドログラムからグループを発見することであり、自然ではなく、ほとんど主観的です。

K- 最近傍

K- 最近傍は機械学習の分類法の中で最も単純な分類法である。 他の機械学習手法とは異なり、モデルを生成しないのが特徴です。 これは、すべての利用可能なケースを保存し、類似性測定に基づいて新しいインスタンスを分類するシンプルなアルゴリズムです。

例と例の間に距離がある場合に非常によく機能する。 学習セットが大きいと学習速度が遅く、距離の計算が非自明である。

主成分分析:

より高次元の空間が欲しい場合。 その空間の基底を選び、その基底の最も重要な200個のスコアだけを選ぶ必要がある。 この基底は主成分として知られています。 選択した部分集合は、元の空間と比較してサイズの小さい新しい空間となります。 また、データの複雑さを可能な限り維持することができます。

Association

Association Ruleは、大規模なデータベース内のデータオブジェクト間の関連付けを確立することができる。 この教師なし技術は、大規模なデータベース内の変数間の興味深い関係を発見することである。 例えば、新しい家を購入した人は、新しい家具を購入する可能性が最も高い。

他の例。

- 遺伝子発現の測定値によってグループ化された癌患者のサブグループ

- 閲覧および購入履歴に基づく買い物客のグループ

- 映画の視聴者によって与えられた評価による映画グループ

Supervised vs. Unservised。 教師なし機械学習

| パラメータ | 教師あり機械学習手法 | 教師なし機械学習手法 |

| 入力データ | アルゴリズムはラベルつきデータを使って学習される。 | ラベル付けされていないデータに対してアルゴリズムを使用する |

| 計算の複雑さ | 教師あり学習はよりシンプルな手法である。 | 教師なし学習は計算複雑 |

| 精度 | 高精度で信頼性の高い方法。 | 精度が低く、信頼できる方法。 |

教師なし機械学習の応用

教師なし機械学習手法の応用例として、以下のものがある。

- クラスタリングは、データセットを自動的に類似性に基づいてグループに分割します。

- 異常検出は、データセット内の異常なデータ点を発見することができます。 これは不正なトランザクションを発見するのに役立つ。

- アソシエーションマイニングは、データセットで一緒に発生することが多いアイテムのセットを識別する。 データセットの特徴の数を減らすとか、データセットを複数のコンポーネントに分解するとか

教師なし学習のデメリット

- データのソートに関する正確な情報を得ることができず、教師なし学習で使用するデータとしての出力はラベル付けされていて知られていない

- 結果の正確さが低くなるのは、入力データが知られておらず事前に人々がラベル付けされていないことが理由である。 つまり、機械が自ら行う必要があるのです。

- スペクトルクラスは、必ずしも情報クラスに対応するとは限らない。

- ユーザはその分類に従ったクラスを解釈し、ラベル付けすることに時間を費やす必要がある。

- クラスのスペクトル特性は時間の経過とともに変化することもあるので、ある画像から別の画像に移動する間、同じクラス情報を持つことはできません。