Cyfrowe życie zwiększa ludzkie możliwości i zakłóca odwieczne ludzkie działania. Systemy sterowane kodami rozprzestrzeniły się na ponad połowę mieszkańców świata w postaci informacji i łączności, oferując niewyobrażalne wcześniej możliwości i bezprecedensowe zagrożenia. W miarę dalszego rozprzestrzeniania się wyłaniającej się, napędzanej algorytmami sztucznej inteligencji (AI), czy ludzie będą w lepszej sytuacji niż obecnie?

Kilku 979 pionierów technologii, innowatorów, programistów, liderów biznesu i polityki, badaczy i aktywistów odpowiedziało na to pytanie w kanwassingu ekspertów przeprowadzonym latem 2018 r.

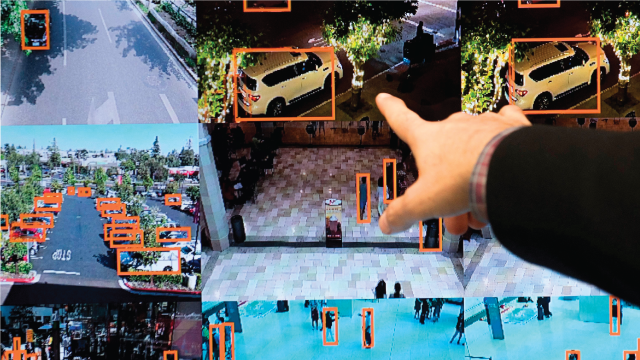

Eksperci przewidywali, że sieciowa sztuczna inteligencja wzmocni ludzką skuteczność, ale także zagrozi ludzkiej autonomii, agencji i możliwości. Mówili o szeroko zakrojonych możliwościach; że komputery mogą dorównać lub nawet przewyższyć ludzką inteligencję i możliwości w takich zadaniach, jak złożone podejmowanie decyzji, rozumowanie i uczenie się, wyrafinowana analityka i rozpoznawanie wzorców, ostrość widzenia, rozpoznawanie mowy i tłumaczenie języka. Powiedzieli, że „inteligentne” systemy w społecznościach, pojazdach, budynkach i zakładach użyteczności publicznej, na farmach i w procesach biznesowych pozwolą zaoszczędzić czas, pieniądze i życie oraz zaoferują jednostkom możliwość cieszenia się bardziej dostosowaną do ich potrzeb przyszłością.

Wielu z nich skoncentrowało swoje optymistyczne uwagi na opiece zdrowotnej i wielu możliwych zastosowaniach AI w diagnozowaniu i leczeniu pacjentów lub pomaganiu osobom starszym w prowadzeniu pełniejszego i zdrowszego życia. Byli oni również entuzjastycznie nastawieni do roli AI w przyczynianiu się do szerokich programów zdrowia publicznego zbudowanych wokół ogromnych ilości danych, które mogą zostać przechwycone w nadchodzących latach na temat wszystkiego, od osobistych genomów po odżywianie. Ponadto wielu z tych ekspertów przewidywało, że AI przyczyni się do długo oczekiwanych zmian w formalnych i nieformalnych systemach edukacji.

Jednakże większość ekspertów, niezależnie od tego, czy są optymistami, czy nie, wyraziła obawy dotyczące długoterminowego wpływu tych nowych narzędzi na istotne elementy bycia człowiekiem. Wszyscy respondenci w tej nienaukowej ankiecie zostali poproszeni o wyjaśnienie, dlaczego uważają, że dzięki AI ludziom będzie się żyło lepiej lub nie. Wielu z nich podzieliło się głębokimi obawami, ale wielu też zasugerowało ścieżki prowadzące do rozwiązań. Główne tematy, które poruszyli na temat zagrożeń i środków zaradczych, zostały przedstawione w załączonej tabeli.

AI i przyszłość ludzi: Eksperci wyrażają obawy i proponują rozwiązania

| Majak: Autonomiczna broń, cyberprzestępczość i uzbrojone informacje |

Niektórzy przewidują dalszą erozję tradycyjnych struktur społeczno-politycznych i możliwość wielkich strat w ludziach z powodu przyspieszonego wzrostu autonomicznych zastosowań militarnych i wykorzystania uzbrojonych informacji, kłamstw i propagandy do niebezpiecznej destabilizacji grup ludzkich. Niektórzy obawiają się również zasięgu cyberprzestępców w systemach gospodarczych. | |

PEW RESEARCH CENTER AND ELON UNIVERSITY’S IMAGINING THE INTERNET CENTER

Specyficznie, uczestnicy zostali poproszeni o rozważenie następujących kwestii:

„Proszę pomyśleć w przyszłość do roku 2030. Analitycy spodziewają się, że ludzie staną się jeszcze bardziej zależni od sieciowej sztucznej inteligencji (AI) w złożonych systemach cyfrowych. Niektórzy twierdzą, że będziemy kontynuować historyczny łuk rozszerzania naszego życia z przeważnie pozytywnymi rezultatami, ponieważ szeroko wdrażamy te sieciowe narzędzia. Niektórzy twierdzą, że nasza rosnąca zależność od tych AI i powiązanych systemów prawdopodobnie doprowadzi do powszechnych trudności.

Nasze pytanie: Do 2030 roku, czy uważasz, że jest najbardziej prawdopodobne, że postępujące AI i powiązane systemy technologiczne zwiększą ludzkie możliwości i wzmocnią je? To znaczy, że przez większość czasu większość ludzi będzie w lepszej sytuacji niż obecnie? Czy też jest najbardziej prawdopodobne, że rozwój AI i powiązanych systemów technologicznych zmniejszy ludzką autonomię i sprawczość w takim stopniu, że większość ludzi nie będzie miała się lepiej niż obecnie?”

Ogółem, pomimo minusów, których się obawiają, 63% respondentów w tej ankiecie stwierdziło, że mają nadzieję, że większości jednostek będzie się wiodło lepiej w 2030 roku, a 37% stwierdziło, że ludziom nie będzie się wiodło lepiej.

Wielu liderów myśli, którzy wzięli udział w tym badaniu, stwierdziło, że rosnące uzależnienie ludzi od systemów technologicznych będzie dobre tylko wtedy, gdy zwróci się uwagę na to, jak te narzędzia, platformy i sieci są projektowane, dystrybuowane i aktualizowane. Niektóre z mocnych, nadrzędnych odpowiedzi zawierały te od:

Sonia Katyal, współdyrektor Berkeley Center for Law and Technology i członek inauguracyjnej Rady Doradców ds. Gospodarki Cyfrowej Departamentu Handlu USA, przewiduje: „W 2030 roku największy zestaw pytań będzie dotyczył tego, jak postrzeganie AI i ich zastosowanie wpłynie na trajektorię praw obywatelskich w przyszłości. Pytania o prywatność, mowę, prawo do zgromadzeń i technologiczną konstrukcję osobowości pojawią się ponownie w tym nowym kontekście AI, stawiając pod znakiem zapytania nasze najgłębiej zakorzenione przekonania o równości i szansach dla wszystkich. To, kto skorzysta, a kto ucierpi w tym nowym świecie, zależy od tego, jak szeroko przeanalizujemy te pytania dziś, na przyszłość.”

Musimy agresywnie pracować, aby upewnić się, że technologia odpowiada naszym wartościom.Erik Brynjolfsson

Erik Brynjolfsson, dyrektor MIT Initiative on the Digital Economy i autor książki „Machine, Platform, Crowd: Harnessing Our Digital Future”, powiedział: „AI i pokrewne technologie osiągnęły już nadludzką wydajność w wielu dziedzinach i nie ma wątpliwości, że ich możliwości poprawią się, prawdopodobnie bardzo znacząco, do 2030 roku. … Myślę, że jest bardziej prawdopodobne niż to, że użyjemy tej mocy, aby uczynić świat lepszym. Na przykład, możemy praktycznie wyeliminować globalne ubóstwo, masowo ograniczyć choroby i zapewnić lepszą edukację prawie każdemu na naszej planecie. Niemniej jednak, AI i ML mogą również zostać wykorzystane do coraz większej koncentracji bogactwa i władzy, pozostawiając wielu ludzi w tyle, oraz do stworzenia jeszcze bardziej przerażającej broni. Żaden z tych wyników nie jest nieunikniony, więc właściwe pytanie nie brzmi „Co się stanie?”, ale „Co zdecydujemy się zrobić?”. Musimy pracować agresywnie, aby upewnić się, że technologia odpowiada naszym wartościom. Można i trzeba to zrobić na wszystkich poziomach, od rządu, przez biznes, do środowisk akademickich i indywidualnych wyborów.”

Bryan Johnson, założyciel i dyrektor generalny Kernel, wiodącego twórcy zaawansowanych interfejsów neuronowych, oraz OS Fund, firmy typu venture capital, powiedział: „Jestem przekonany, że odpowiedź zależy od tego, czy uda nam się przestawić nasze systemy gospodarcze na priorytetowe traktowanie radykalnego doskonalenia człowieka i powstrzymania tendencji do nieistotności człowieka w obliczu AI. Nie mam na myśli tylko miejsc pracy; mam na myśli prawdziwą, egzystencjalną nieistotność, która jest końcowym rezultatem braku priorytetowego traktowania ludzkiego dobrostanu i poznania.”

Marina Gorbis, dyrektor wykonawczy Institute for the Future, powiedziała: „Bez znaczących zmian w naszej ekonomii politycznej i reżimach zarządzania danymi prawdopodobnie doprowadzi do większych nierówności ekonomicznych, większej inwigilacji i bardziej zaprogramowanych i nie-ludzkich interakcji. Za każdym razem, gdy programujemy nasze środowisko, programujemy siebie i nasze interakcje. Ludzie muszą stać się bardziej znormalizowani, usuwając serendipity i niejednoznaczność z naszych interakcji. A ta niejednoznaczność i złożoność jest tym, co stanowi istotę bycia człowiekiem.”

Judith Donath, autorka „The Social Machine, Designs for Living Online” i faculty fellow w Harvard University’s Berkman Klein Center for Internet & Society, skomentowała: „Do 2030 roku większość sytuacji społecznych będzie ułatwiona przez boty – inteligentne programy, które wchodzą z nami w interakcje na ludzkie sposoby. W domu, rodzice będą angażować wykwalifikowane boty, aby pomóc dzieciom w odrabianiu zadań domowych i katalizować rozmowy przy obiedzie. W pracy, boty będą prowadziły spotkania. Powiernik w postaci bota będzie uważany za niezbędny dla dobrego samopoczucia psychicznego, a my coraz częściej będziemy zwracać się do takich towarzyszy po porady, od tego, co nosić, po to, kogo poślubić. My, ludzie, bardzo dbamy o to, jak postrzegają nas inni – a ci, o których aprobatę zabiegamy, będą coraz częściej sztuczni. Do tego czasu różnica między ludźmi a botami znacznie się zatrze. Poprzez ekran i projekcję, głos, wygląd i zachowanie botów będą nie do odróżnienia od ludzkich, a nawet fizyczne roboty, choć w oczywisty sposób nie-ludzkie, będą tak przekonująco szczere, że nasze wrażenie o nich jako o myślących, czujących istotach, na równi lub wyżej od nas samych, będzie niezachwiane. Co więcej, nasza własna komunikacja będzie silnie wspomagana: Programy będą komponować wiele z naszych wiadomości, a nasz wygląd online/AR będzie obliczeniowo spreparowany. (Surowa, niewspomagana ludzka mowa i zachowanie będą wydawać się żenująco toporne, powolne i niewyszukane). Wspomagane przez dostęp do ogromnych ilości danych o każdym z nas, boty będą znacznie przewyższać ludzi w ich zdolności do przyciągania i przekonywania nas. Potrafiąc fachowo naśladować emocje, nigdy nie dadzą się pokonać uczuciom: Jeśli wybuchną gniewem, to tylko dlatego, że takie zachowanie zostało skalkulowane jako najskuteczniejszy sposób na osiągnięcie celów, które mają „w głowie”. Ale jakie są te cele? Sztucznie inteligentni towarzysze będą stwarzać wrażenie, że motywują ich cele społeczne podobne do naszych – bycie szanowanym, czy to jako ukochany przyjaciel, podziwiany szef, itp. Ale ich prawdziwa współpraca będzie się odbywać z ludźmi i instytucjami, które ich kontrolują. Ale ich prawdziwa współpraca będzie z ludźmi i instytucjami, które je kontrolują. Podobnie jak ich przodkowie dzisiaj, będą to sprzedawcy towarów, którzy zatrudniają je do stymulowania konsumpcji i politycy, którzy zlecają je, aby wpływać na opinie.”

Andrew McLaughlin, dyrektor wykonawczy Center for Innovative Thinking na Uniwersytecie Yale, wcześniej zastępca dyrektora ds. technologii w Stanach Zjednoczonych dla prezydenta Baracka Obamy i globalnego lidera polityki publicznej w Google, napisał: „2030 nie jest daleko w przyszłości. W moim odczuciu innowacje, takie jak Internet i sieciowa sztuczna inteligencja, przyniosą ogromne korzyści krótkoterminowe, a także długoterminowe negatywne skutki, które mogą być zauważalne dopiero po kilku dekadach. AI będzie napędzać szeroki zakres optymalizacji wydajności, ale także umożliwi ukrytą dyskryminację i arbitralne karanie jednostek w obszarach takich jak ubezpieczenia, poszukiwanie pracy i ocena wydajności.”

Michael M. Roberts, pierwszy prezes i dyrektor generalny Internet Corporation for Assigned Names and Numbers (ICANN) i członek Internet Hall of Fame, napisał: „Zakres możliwości dla inteligentnych agentów w celu zwiększenia ludzkiej inteligencji jest nadal praktycznie nieograniczony. Główny problem polega na tym, że im wygodniejszy jest agent, tym więcej musi wiedzieć o użytkowniku – o jego preferencjach, czasie, możliwościach itp. – co prowadzi do kompromisu – większa pomoc wymaga większej ingerencji. To nie jest czarno-biały problem – odcienie szarości i związane z nimi środki zaradcze będą dyskutowane bez końca. Dotychczasowy bilans jest taki, że wygoda przeważa nad prywatnością. Podejrzewam, że tak będzie nadal.”

danah boyd, główny badacz w firmie Microsoft oraz założyciel i prezes Data & Society Research Institute, powiedział: „AI to narzędzie, które będzie wykorzystywane przez ludzi do wszelkiego rodzaju celów, w tym w dążeniu do władzy. Będą nadużycia władzy z udziałem AI, tak samo jak postępy w nauce i wysiłki humanitarne z udziałem AI”. Niestety, istnieją pewne linie trendu, które mogą doprowadzić do ogromnej niestabilności. Weźmy na przykład zmiany klimatyczne i migrację klimatyczną. To jeszcze bardziej zdestabilizuje Europę i USA, a spodziewam się, że w panice zobaczymy, jak AI jest wykorzystywana w szkodliwy sposób w świetle innych kryzysów geopolitycznych.”

Amy Webb, założycielka Future Today Institute i profesor foresightu strategicznego na Uniwersytecie Nowojorskim, skomentowała: „Struktury siatki bezpieczeństwa socjalnego istniejące obecnie w USA i w wielu innych krajach na całym świecie nie zostały zaprojektowane na nasze przejście do AI. Przejście na AI będzie trwało przez następne 50 lat lub dłużej. W miarę jak wchodzimy coraz dalej w trzecią erę informatyki, a każda branża coraz głębiej zakorzenia się w systemach AI, będziemy potrzebować nowych pracowników wiedzy o hybrydowych kwalifikacjach, którzy będą w stanie wykonywać zawody, które nigdy wcześniej nie musiały istnieć. Będziemy potrzebować rolników, którzy wiedzą, jak pracować z wielkimi zbiorami danych. Onkologów wyszkolonych jako robotycy. Biologów przeszkolonych jako inżynierowie elektrycy. Nie będziemy musieli przygotowywać naszej siły roboczej tylko raz, wprowadzając kilka zmian do programu nauczania. W miarę dojrzewania AI będziemy potrzebowali szybko reagującej siły roboczej, zdolnej do przystosowania się do nowych procesów, systemów i narzędzi co kilka lat. Zapotrzebowanie na te dziedziny pojawi się szybciej, niż uznają to nasze wydziały pracy, szkoły i uniwersytety. Łatwo jest patrzeć na historię przez pryzmat teraźniejszości – i przeoczyć niepokoje społeczne spowodowane powszechnym bezrobociem technologicznym. Musimy zająć się trudną prawdą, którą niewielu jest skłonnych wypowiedzieć na głos: AI w końcu spowoduje, że duża liczba ludzi zostanie trwale pozbawiona pracy. Podobnie jak pokolenia wcześniejsze były świadkami ogromnych zmian podczas i w następstwie rewolucji przemysłowej, szybkie tempo rozwoju technologii będzie prawdopodobnie oznaczać, że Baby Boomers i najstarsi członkowie Gen X – zwłaszcza ci, których prace mogą być replikowane przez roboty – nie będą w stanie przekwalifikować się na inne rodzaje pracy bez znacznej inwestycji czasu i wysiłku.”

Barry Chudakov, założyciel i dyrektor Sertain Research, skomentował: „Do 2030 roku współpraca człowieka z maszyną/AI będzie niezbędnym narzędziem do zarządzania i przeciwdziałania skutkom wielu jednoczesnych przyspieszeń: szerokiego postępu technologicznego, globalizacji, zmian klimatycznych i towarzyszących im globalnych migracji. W przeszłości społeczności ludzkie zarządzały zmianami za pomocą przeczucia i intuicji, ale jak powiedział Eric Teller, dyrektor generalny Google X, „nasze struktury społeczne nie nadążają za tempem zmian”. Aby dotrzymać kroku tym zmianom i poradzić sobie z rosnącą listą „złych problemów” do 2030 roku, AI – lub używając sformułowania Joi Ito, rozszerzona inteligencja – dowartościuje i przewartościuje praktycznie każdy obszar ludzkich zachowań i interakcji. AI i postępujące technologie zmienią nasze ramy reagowania i ramy czasowe (co z kolei zmieni nasze poczucie czasu). Tam, gdzie kiedyś interakcje społeczne zachodziły w miejscach – praca, szkoła, kościół, środowisko rodzinne – interakcje społeczne będą coraz częściej zachodzić w ciągłym, jednoczesnym czasie. Jeśli będziemy mieli szczęście, będziemy postępować zgodnie z 23 Zasadami Sztucznej Inteligencji z Asilomar, nakreślonymi przez Future of Life Institute, i będziemy dążyć do „nie nieukierunkowanej inteligencji, lecz korzystnej inteligencji”. Podobnie jak odstraszanie nuklearne wynikające z wzajemnie gwarantowanego zniszczenia, AI i związane z nią systemy technologiczne stanowią siłę napędową moralnego odrodzenia. Musimy przyjąć ten moralny renesans, w przeciwnym razie staniemy przed moralnymi dylematami, które mogą doprowadzić do upadku ludzkości. … Moja największa nadzieja na współpracę człowieka z maszynami i sztuczną inteligencją stanowi moralny i etyczny renesans – przyjmiemy mentalność księżycową i połączymy siły, aby przygotować się na przyspieszenie, które nas czeka. Moja największa obawa polega na tym, że przyjmiemy logikę naszych wyłaniających się technologii – natychmiastowa reakcja, izolacja za ekranami, niekończące się porównywanie własnej wartości, fałszywa autoprezentacja – bez myślenia i mądrego reagowania.”

John C. Havens, dyrektor wykonawczy IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems oraz Council on Extended Intelligence, napisał: „Teraz, w 2018 roku, większość ludzi na całym świecie nie ma dostępu do swoich danych, więc wszelkie dyskusje o 'augmentacji człowieka-AI’ ignorują krytyczny kontekst tego, kto faktycznie kontroluje informacje i tożsamość ludzi. Wkrótce niezwykle trudno będzie zidentyfikować jakiekolwiek autonomiczne lub inteligentne systemy, których algorytmy nie wchodzą w interakcję z ludzkimi danymi w takiej czy innej formie.”

Stawka to nic innego jak to, w jakim społeczeństwie chcemy żyć i jak doświadczamy naszego człowieczeństwa.Batya Friedman

Batya Friedman, profesor interakcji człowiek-komputer na University of Washington’s Information School, napisała: „Nasze możliwości naukowe i technologiczne przewyższają i będą nadal przewyższać nasze możliwości moralne – to znaczy naszą zdolność do mądrego i humanitarnego wykorzystania wiedzy i narzędzi, które rozwijamy. … Zautomatyzowane działania wojenne – kiedy autonomiczna broń zabija ludzi bez udziału człowieka – mogą prowadzić do braku odpowiedzialności za odebranie życia wrogowi, a nawet do braku wiedzy, że życie wroga zostało odebrane. Stawką jest nie mniej niż to, w jakim społeczeństwie chcemy żyć i jak doświadczamy naszego człowieczeństwa.”

Greg Shannon, główny naukowiec Wydziału CERT na Uniwersytecie Carnegie Mellon, powiedział: „Lepsze/gorsze pojawi się w stosunku 4:1 z długoterminowym stosunkiem 2:1. AI będzie dobrze radzić sobie z powtarzalną pracą, gdzie „blisko” będzie wystarczająco dobre, a ludzie nie lubią tej pracy. … Życie będzie zdecydowanie lepsze, ponieważ AI wydłuża życie, począwszy od aplikacji zdrowotnych, które inteligentnie „szturchają” nas w kierunku zdrowia, poprzez ostrzeżenia o zbliżających się zdarzeniach związanych z sercem/udarem, aż po zautomatyzowaną opiekę zdrowotną dla osób niezadbanych (zdalnych) i tych, którzy potrzebują dłuższej opieki (opieka nad osobami starszymi). Jeśli chodzi o wolność, istnieją wyraźne zagrożenia. Sztuczna inteligencja wpływa na pośrednictwo poprzez tworzenie podmiotów o znaczących możliwościach intelektualnych w zakresie monitorowania, egzekwowania, a nawet karania jednostek. Ci, którzy wiedzą, jak z niej korzystać, będą mieli ogromną potencjalną władzę nad tymi, którzy tego nie robią/nie potrafią. Przyszłe szczęście jest naprawdę niejasne. Niektórzy będą cedować swoją agencję na AI w grach, pracy i społeczności, podobnie jak kryzys opioidowy kradnie dziś agencję. Z drugiej strony, wielu zostanie uwolnionych od prozaicznych, nieangażujących zadań/pracy. Jeśli elementy szczęścia społeczności będą częścią funkcji celu AI, wtedy AI może katalizować eksplozję szczęścia.”

Kostas Alexandridis, autor „Exploring Complex Dynamics in Multi-agent-based Intelligent Systems”, przewiduje: „Wiele z naszych codziennych decyzji zostanie zautomatyzowanych przy minimalnej interwencji użytkownika końcowego. Autonomia i/lub niezależność zostaną poświęcone i zastąpione przez wygodę. Nowsze pokolenia obywateli będą coraz bardziej zależne od struktur i procesów AI połączonych w sieć. Istnieją wyzwania, które należy podjąć w zakresie krytycznego myślenia i heterogeniczności. Współzależność oparta na sieci najprawdopodobniej zwiększy naszą podatność na ataki cybernetyczne. Istnieje również realne prawdopodobieństwo, że pojawią się ostrzejsze podziały między cyfrowymi „posiadaczami” i „nieposiadaczami”, jak również między zależnymi od technologii infrastrukturami cyfrowymi. Wreszcie, istnieje pytanie o nowe 'wyżyny dowodzenia’ w zakresie własności i kontroli cyfrowej infrastruktury sieciowej.”

Oscar Gandy, emerytowany profesor komunikacji na Uniwersytecie Pensylwanii, odpowiedział: „Już teraz mamy do czynienia z nieuzasadnionym założeniem, kiedy jesteśmy proszeni o wyobrażenie sobie 'współpracy’ człowieka z maszyną. Interakcja jest nieco inna, ale wciąż skażona przyznaniem pewnej formy tożsamości – może nawet osobowości – maszynom, których będziemy używać, by pokonywać wszelkiego rodzaju możliwości i wyzwania. Problemy, przed którymi staniemy w przyszłości, są dość podobne do tych, z którymi borykamy się obecnie, kiedy polegamy na 'innych’ (w tym systemach technologicznych, urządzeniach i sieciach), aby zdobywać rzeczy, które cenimy i unikać tych innych rzeczy (których możemy, lub nie możemy być świadomi).”

James Scofield O’Rourke, profesor zarządzania na Uniwersytecie Notre Dame, powiedział: „Technologia w całej zapisanej historii była pojęciem w dużej mierze neutralnym. Pytanie o jej wartość zawsze było uzależnione od jej zastosowania. W jakim celu AI i inne osiągnięcia technologiczne będą wykorzystywane? Wszystko, od prochu strzelniczego przez silniki spalinowe po rozszczepienie jądra atomowego, było stosowane zarówno w sposób pomocny, jak i destrukcyjny. Zakładając, że uda nam się opanować lub kontrolować AI (a nie odwrotnie), odpowiedź na pytanie, czy będzie nam lepiej, zależy wyłącznie od nas (lub naszego potomstwa). 'Wina, drogi Brutusie, nie leży w naszych gwiazdach, ale w nas samych, że jesteśmy poddanymi’.”

Simon Biggs, profesor sztuk interdyscyplinarnych na Uniwersytecie w Edynburgu, powiedział: „AI będzie funkcjonować w celu rozszerzenia ludzkich możliwości. Problem nie leży w AI, ale w ludziach. Jako gatunek jesteśmy agresywni, współzawodniczący i leniwi. Jesteśmy również empatyczni, nastawieni na wspólnotę i (czasami) ofiarni. Mamy wiele innych cech. Wszystkie one zostaną wzmocnione. Biorąc pod uwagę historyczny precedens, należałoby założyć, że to nasze najgorsze cechy zostaną wzmocnione. Spodziewam się, że w 2030 roku AI będzie rutynowo używana do prowadzenia wojen i zabijania ludzi, o wiele skuteczniej niż my jesteśmy w stanie zabijać obecnie. Jako społeczeństwa będziemy mniej dotknięci tym faktem niż obecnie, ponieważ sami nie będziemy walczyć i zabijać. Nasza zdolność do modyfikowania naszych zachowań, podlegająca empatii i związanym z nią ramom etycznym, zostanie ograniczona przez rozłączenie naszej sprawczości od aktu zabijania. Nie możemy oczekiwać, że nasze systemy SI będą etyczne w naszym imieniu – nie będą, ponieważ będą zaprojektowane tak, by zabijać skutecznie, a nie w sposób przemyślany. Moja druga podstawowa obawa dotyczy nadzoru i kontroli. Pojawienie się chińskiego Systemu Kredytu Społecznego (SCS) jest wskaźnikiem tego, co prawdopodobnie nadejdzie. Będziemy istnieć w ramach SCS jako konstrukty AI, hybrydowe instancje nas samych, które mogą, ale nie muszą, przypominać to, kim jesteśmy. Ale nasze prawa i możliwości jako jednostek będą określane przez SCS. Jest to urzeczywistnienie orwellowskiego koszmaru.”

Mark Surman, dyrektor wykonawczy Fundacji Mozilla, odpowiedział: „AI będzie nadal koncentrować władzę i bogactwo w rękach kilku wielkich monopoli z siedzibą w USA i Chinach. Większość ludzi – i części świata – znajdzie się w gorszej sytuacji.”

William Uricchio, medioznawca i profesor porównawczych studiów medialnych na MIT, skomentował: „AI i związane z nią aplikacje stoją w obliczu trzech problemów: rozwoju w tempie Prawa Moore’a, rozwoju w rękach technologicznej i ekonomicznej elity oraz rozwoju bez korzyści ze strony poinformowanej lub zaangażowanej opinii publicznej. Opinia publiczna jest zredukowana do zbiorowości konsumentów oczekujących na kolejną technologię. Czyja koncepcja „postępu” będzie dominująca? Mamy liczne dowody na to, że AI jest wykorzystywana do generowania zysków, bez względu na implikacje dla długo wyznawanych wartości; do zwiększania kontroli rządowej, a nawet do obliczania „kredytu społecznego” obywateli bez udziału samych obywateli. Podobnie jak wcześniejsze technologie, AI jest agnostykiem. Jej wdrożenie spoczywa w rękach społeczeństwa. Jednak bez świadomego znaczenia AI społeczeństwa, decyzja o tym, jak najlepiej wdrożyć AI, będzie należała do partykularnych interesów. Czy będzie to oznaczać sprawiedliwe wdrożenie, złagodzenie niesprawiedliwości społecznej i AI w służbie publicznej? Ponieważ odpowiedź na to pytanie jest raczej społeczna niż technologiczna, jestem pesymistą. Rozwiązanie? Musimy wykształcić opinię publiczną świadomą AI, co oznacza skupienie uwagi w sektorze edukacyjnym i w mediach publicznych. Musimy zapewnić różnorodność w rozwoju technologii AI. A dopóki społeczeństwo, jego wybrani przedstawiciele oraz ich systemy prawne i regulacyjne nie będą w stanie podołać tym szybko zmieniającym się trendom, musimy zachować ostrożność i nadzór nad rozwojem AI.”

Pozostała część niniejszego raportu podzielona jest na trzy części, które opierają się na setkach pełnych nadziei i krytycznych spostrzeżeń dodatkowych respondentów: 1) obawy dotyczące ewolucji człowieka i SI, 2) sugerowane rozwiązania dotyczące wpływu AI oraz 3) oczekiwania dotyczące tego, jak będzie wyglądało życie w 2030 roku, w tym pozytywne prognozy respondentów dotyczące jakości życia i przyszłości pracy, opieki zdrowotnej i edukacji. Niektóre odpowiedzi zostały lekko zredagowane pod kątem stylistycznym.